バックナンバーはこちら

※ 近日公開

要約(3行)

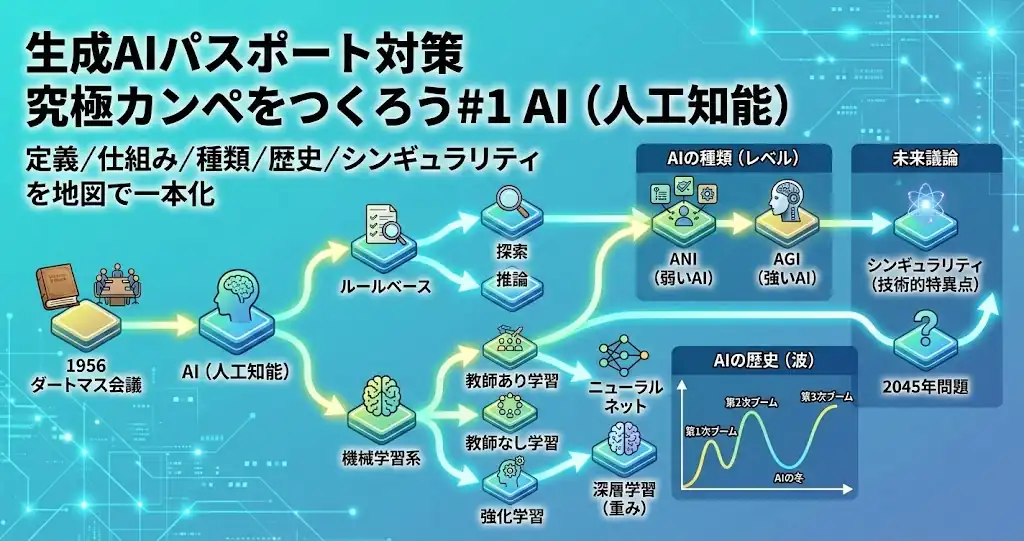

AIは広い言葉なので、定義・仕組み・種類・歴史・未来議論を「一本の線」でつなぐのが近道です。

ルールベース→機械学習→深層学習、現実はANI/目標はAGI、歴史は波、未来は論点として置きます。

この地図があると、単語を忘れても関係性から復元できるようになります。

- 動画解説

- 因果関係図(全体マップ)

- AI(人工知能)の定義と境界

- ルールベース系(探索・推論)

- 機械学習系(学習タイプの分岐)

- ニューラルネット/深層学習(重みが核)

- 学習の落とし穴と対策(過学習・正則化・ドロップアウト・転移学習)

- AIの種類(レベル):ANIとAGI、特徴量

- AIの歴史(波):第一次・第二次・冬・第三次

- 未来議論:シンギュラリティ、2045年問題、AI効果

- 復元チェック:原因・セット・結果

- FAQ

- まとめ

- 参考文献

- 資格対策(生成AIパスポートの“点”を固める)

- 全体像・定義(地図づくりの起点)

- ルールベース(探索・推論)と古典AI

- 機械学習(教師あり/教師なし/特徴量/評価)

- 深層学習(ニューラルネット/重み/過学習と対策)

- 強化学習(報酬で学ぶ)

- 歴史(ブームと冬)を“波”で押さえる

- 未来議論(AGI→シンギュラリティ、2045年問題)

- 倫理・社会(AI効果と“当たり前化”を混ぜない)

- 最短ルート 3冊+問題集

動画解説

※ 近日公開

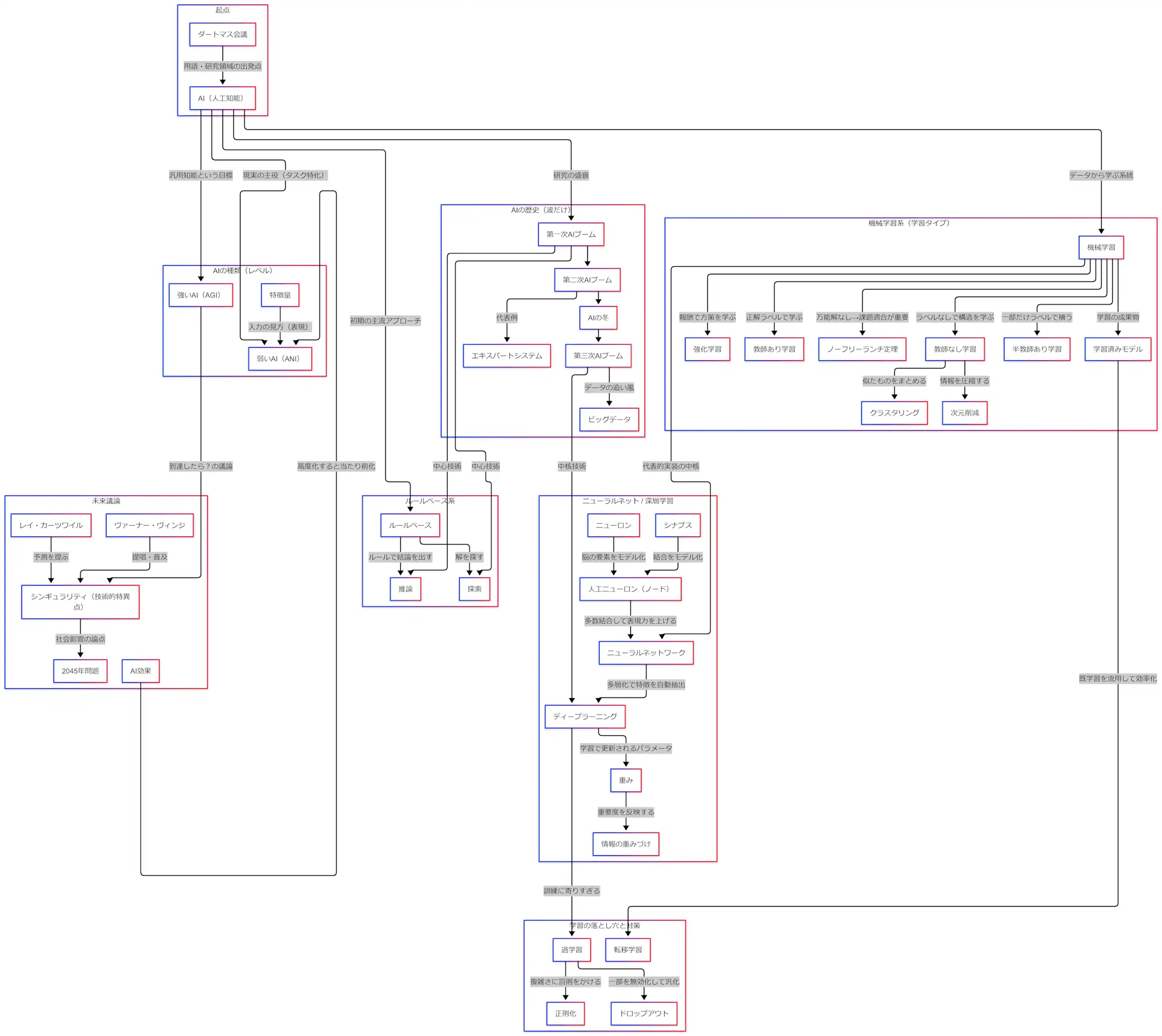

因果関係図(全体マップ)

まずは全体を俯瞰します。ここで大事なのは、細部より「順路」です。図を上から下へたどるだけで、AIの話題が一本につながります。

この地図は大きく6ブロックに分けて見ます。

- 起点(ダートマス)

- ルールベース(探索・推論)

- 機械学習(学習タイプの分岐)

- ニューラルネット/深層学習(重みが核)

- 学習の落とし穴と対策(過学習→正則化・ドロップアウト、転移学習)

- 種類(ANI/AGI)/歴史(波)/未来議論(シンギュラリティ、AI効果)

AI(人工知能)の定義と境界

「AIとは何か」は、立場によって言い方が揺れます。試験対策としては、次の2つに分けて置くと迷いにくいです。

- 研究領域としてのAI(分野の名前)

- AIシステムとしてのAI(実体としてのシステム)

研究領域としての起点は、ダートマス会議(周辺の提案書・研究計画)として語られることが多いです(1955年の提案書、1956年夏の研究計画)。

https://people.csail.mit.edu/brooks/idocs/DartmouthProposal.pdf

https://archive.computerhistory.org/resources/access/text/2023/06/102720392-05-01-acc.pdf

一方、制度・標準の文脈では「AIシステム」の定義が使われます。たとえばOECDは、AIを各国が扱うための共通土台としてAIシステム定義を整備し、2023年に定義を更新しています。

https://legalinstruments.oecd.org/api/print?ids=648&lang=en

https://www.oecd.org/en/publications/explanatory-memorandum-on-the-updated-oecd-definition-of-an-ai-system_623da898-en.html

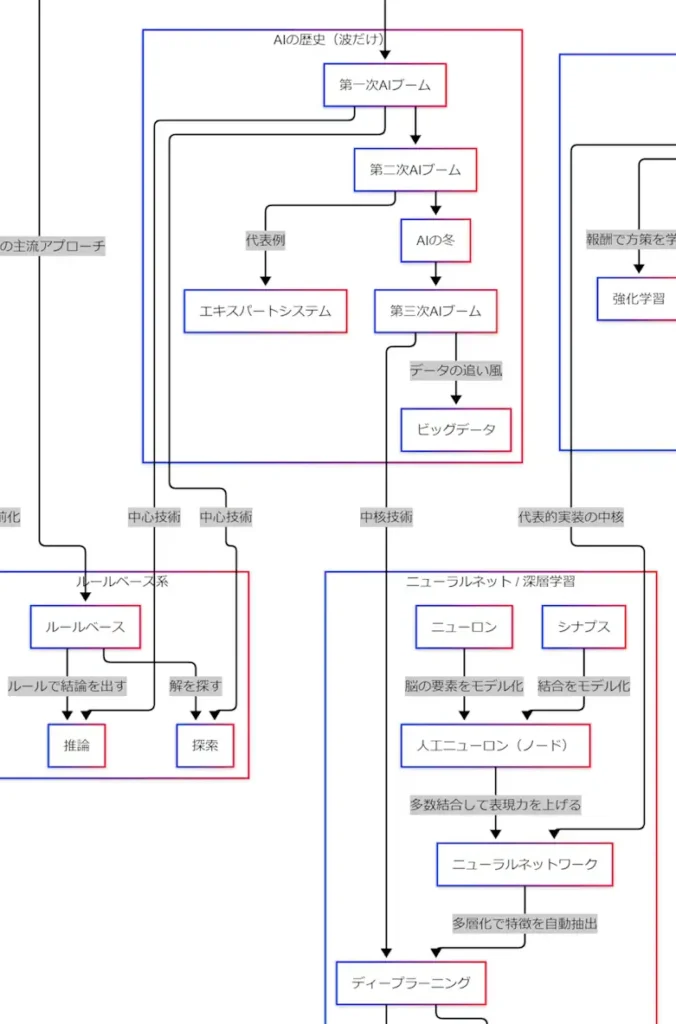

ルールベース系(探索・推論)

図の「AI→ルールベース→探索/推論」を見ます。ここは「人が知識をルールとして書く方式」として押さえると一気に整理できます。

- 探索:解を探す動きです(迷路の経路を探すイメージです)

- 推論:ルールに従って結論を出す動きです(もしAならB、の連鎖です)

ポイントは、データから自動で学ぶのではなく、人がルールを整備して動かすところです。ここが次の「機械学習」との分岐点になります。

機械学習系(学習タイプの分岐)

図の「AI→機械学習」を見てください。ここからは「データから学ぶ」系統になります。試験で混ざりやすいのは、学習タイプの違いです。矢印の意味で覚えると安定します。

- 教師あり学習:正解ラベルで学びます

- 教師なし学習:ラベルなしで構造を学びます

- 半教師あり学習:一部だけラベルで補います

- 強化学習:報酬で方策を学びます

教師なし学習の代表は、この2つがセットで出やすいです。

- クラスタリング:似たものをまとめます

- 次元削減:情報を圧縮します

機械学習の成果物は「学習済みモデル」と置きます。ここが後段の「転移学習(流用)」につながります。

さらに、万能な学習法はないという主張として「ノーフリーランチ定理」が置かれます。言い切りとして暗記するより、「課題に合わせた選択が必要」という結論とセットにすると使いやすいです。

https://www.cs.ubc.ca/~hutter/earg/papers07/00585893.pdf

ニューラルネット/深層学習(重みが核)

図の「ニューロン/シナプス→ノード→ニューラルネット→ディープラーニング→重み」をたどります。

- ニューロンやシナプスを、人工ニューロン(ノード)としてモデル化します

- ノードを多数つなぐとニューラルネットワークになります

- 多層化すると特徴を自動抽出しやすくなり、深層学習(ディープラーニング)につながります

ここで「学習している感」の中心が、重みです。重みは、入力情報の重要度をどう配分するかを表すつまみとして見るとイメージが崩れにくいです。

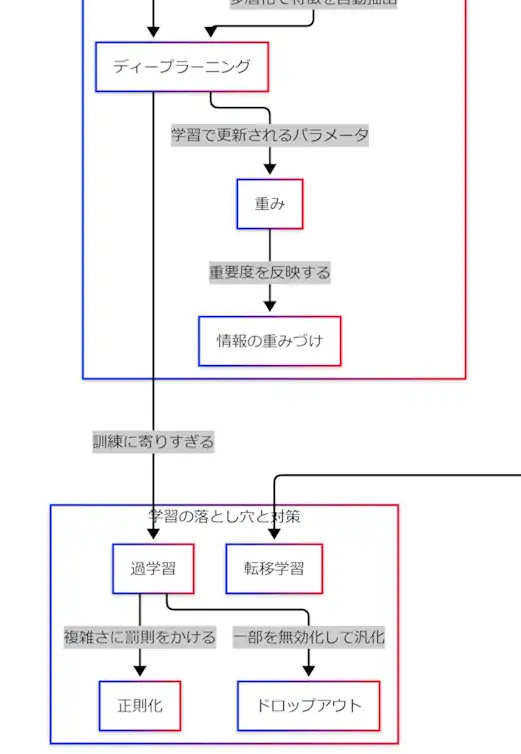

学習の落とし穴と対策(過学習・正則化・ドロップアウト・転移学習)

図の「ディープラーニング→過学習→正則化/ドロップアウト」を見ます。深層学習は強力ですが、訓練データに寄りすぎる過学習が起きやすいです。

https://en.wikipedia.org/wiki/Overfitting

代表的な対策として、図には次が置かれています。

- 正則化:モデルが複雑になりすぎないよう罰則をかけます

- ドロップアウト:学習中に一部のユニットを無効化して汎化を促します

ドロップアウトは、深層学習の過学習対策として定番化した手法です(原論文)。

https://jmlr.org/papers/v15/srivastava14a.html

https://jmlr.org/papers/volume15/srivastava14a/srivastava14a.pdf

そして、実務でも試験でも効くのが転移学習です。学習済みモデルを別タスクに流用して、データや計算の負担を下げます。全体像としては「学習済みモデル→転移学習」の一本矢印で押さえます。

https://www.cse.ust.hk/~qyang/Docs/2009/tkde_transfer_learning.pdf

AIの種類(レベル):ANIとAGI、特徴量

図の「AI→ANI/AGI」と「特徴量→ANI」を確認します。

現実の主役は、基本的に弱いAI(ANI)として整理します。ANIはタスク特化で、特定の目的に強いです。

一方で強いAI(AGI)は汎用知能という目標側の概念として置きます。ここを混ぜると、未来議論(シンギュラリティ)と現実の話が衝突しやすいです。

弱いAIに絡む重要語が特徴量です。特徴量は「入力の見方(表現)」で、タスク特化の性能を左右します。図で「特徴量→ANI」と刺さっているのは、その位置づけを示すためだと考えると覚えやすいです。

AIの歴史(波):第一次・第二次・冬・第三次

図の「第一次→第二次→冬→第三次」を見てください。年号暗記より、中心技術が移る“波”として覚える方が復元しやすいです。

- 第一次:探索と推論が中心

- 第二次:エキスパートシステムが代表

- AIの冬:期待と投資がしぼむ時期

- 第三次:ビッグデータの追い風と、深層学習が中核

AI史を俯瞰する一次解説として、ブリタニカの歴史記事がまとまっています。

https://www.britannica.com/science/history-of-artificial-intelligence

未来議論:シンギュラリティ、2045年問題、AI効果

図の最後は「AGI→シンギュラリティ」です。ここは確定未来ではなく、論点として置きます。つまり、現実のANIの話題とは棚を分けます。

シンギュラリティ(技術的特異点)の文脈で頻出するのが、ヴァーナー・ヴィンジとレイ・カーツワイルです。ヴィンジの論文はNASAのアーカイブでも参照できます。

https://ntrs.nasa.gov/citations/19940022856

また、「2045年」という予測が論点として整理される例は学術誌でも確認できます。

https://www.jstage.jst.go.jp/article/jjsai/29/3/29_258/_pdf

もう1つ、現実側に効く概念がAI効果です。高度化して当たり前になると、AIと呼ばれなくなる現象として説明されます。定義問題で「AIの範囲」が揺れる理由の1つとして置くと、話が整います。

https://en.wikipedia.org/wiki/AI_effect

復元チェック:原因・セット・結果

この地図が頭に入っているかは、3点で復元できるかで確認します。

- 原因:それは何がきっかけで必要になりましたか

- セット:一緒に覚える相棒・対比は何ですか

- 結果:それが進むと次に何が起きますか

たとえばディープラーニングなら、こう復元します。

ニューラルネットを多層化したのが原因で、重みがセットで、過学習が結果として出やすいので正則化やドロップアウトにつながります。

この「原因→セット→結果」が言えると、定義が一部抜けても選択肢で迷いにくくなります。

FAQ

Q. AI(人工知能)と機械学習は同じですか

A. 同じではありません。AIは広い枠で、機械学習は「データから学ぶ」アプローチの1系統として位置づけます。制度文脈ではAIシステム定義(例:OECD)を押さえると境界が安定します。https://legalinstruments.oecd.org/api/print?ids=648&lang=en

Q. ルールベースと機械学習の違いは何ですか

A. ルールベースは人が知識をルールとして書き、探索・推論で結論を出します。機械学習はデータから規則性を学び、学習済みモデルとして成果物を得ます。

Q. 教師あり/教師なし/強化学習はどう見分けますか

A. 見分けの軸は「何が学習信号か」です。教師ありは正解ラベル、教師なしはラベルなしで構造、強化学習は報酬です。

Q. 過学習の対策は何が定番ですか

A. 正則化とドロップアウトが代表です。ドロップアウトは深層学習の過学習対策として広く参照される手法です。https://jmlr.org/papers/v15/srivastava14a.html

Q. シンギュラリティは今の生成AIと直結しますか

A. 直結させるより、「AGIに到達したら?」という未来議論の棚に置く方が混ざりにくいです。現実の主役ANIと分けて整理します。https://ntrs.nasa.gov/citations/19940022856

まとめ

AIは単語が多い分野ですが、図の矢印で「順路」を持つと崩れにくいです。

起点(ダートマス)から、ルールベースと機械学習の二系統、深層学習の核(重み)、落とし穴と対策、ANI/AGIのレイヤー、歴史の波、未来議論の棚分けまでが一本になります。

この一本線を持ったうえで細部を足すと、暗記が復元型に変わります。

- ルール→学習→深層、で仕組みを一本化します

- 現実ANI/目標AGI、でレイヤーを分離します

- 歴史は波、未来は論点、で混線を防ぎます

参考文献

- OECD, Recommendation of the Council on Artificial Intelligence(本文・定義改訂の案内含む)

https://legalinstruments.oecd.org/api/print?ids=648&lang=en - OECD, Explanatory memorandum on the updated OECD definition of an AI system(定義改訂の解説)

https://www.oecd.org/en/publications/explanatory-memorandum-on-the-updated-oecd-definition-of-an-ai-system_623da898-en.html - NIST, Artificial Intelligence Risk Management Framework (AI RMF 1.0)

https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf - John McCarthy et al., A Proposal for the Dartmouth Summer Research Project on Artificial Intelligence(1955提案書)

https://people.csail.mit.edu/brooks/idocs/DartmouthProposal.pdf - Computer History Museum, A proposal for the Dartmouth Summer Research Project on Artificial Intelligence(アーカイブ)

https://archive.computerhistory.org/resources/access/text/2023/06/102720392-05-01-acc.pdf - Wolpert & Macready, No Free Lunch Theorems for Optimization(関連PDF)

https://www.cs.ubc.ca/~hutter/earg/papers07/00585893.pdf - Srivastava et al., Dropout: A Simple Way to Prevent Neural Networks from Overfitting(JMLR)

https://jmlr.org/papers/v15/srivastava14a.html - Pan & Yang, A Survey on Transfer Learning(転移学習のサーベイ)

https://www.cse.ust.hk/~qyang/Docs/2009/tkde_transfer_learning.pdf - Encyclopaedia Britannica, history of artificial intelligence(AI史の俯瞰)

https://www.britannica.com/science/history-of-artificial-intelligence - NASA NTRS, Vinge, The Coming Technological Singularity(一次資料)

https://ntrs.nasa.gov/citations/19940022856 - 人工知能学会誌(J-STAGE), 2045年問題(技術的特異点と2045年予測の言及)

https://www.jstage.jst.go.jp/article/jjsai/29/3/29_258/_pdf - Wikipedia, Overfitting(過学習の概説)

https://en.wikipedia.org/wiki/Overfitting - Wikipedia, AI effect(AI効果の概説)

https://en.wikipedia.org/wiki/AI_effect

バックナンバーはこちら

※ 近日公開

資格対策(生成AIパスポートの“点”を固める)

公式テキスト生成AIパスポート テキスト&問題集

記事が「線(関係性)」を作る役なら、これは「点(出題形式)」を固める役。演習→模擬で仕上げたいときに便利。

深層学習教科書 ディープラーニングG検定(ジェネラリスト)公式テキスト(翔泳社)

「DL→過学習→対策」など、周辺資格の定番整理で補強したいときに使える(生成AIパスポートの理解底上げにもなる)。

全体像・定義(地図づくりの起点)

人工知能は人間を超えるか ディープラーニングの先にあるもの(松尾 豊 / KADOKAWA)

「AIって結局なに?」を、歴史と技術の流れで一本化したいときに合う。定義・背景・未来議論(シンギュラリティ手前)までの“地図”づくり向き。

エージェントアプローチ人工知能 第2版(Stuart Russell, Peter Norvig / 共立出版)

ルールベース(探索・推論)から学習までを「知的エージェント」という軸で統合した定番テキスト。因果関係図を、より体系的に補強したいときに強い。

AI事典(土屋 俊 編 / 共立出版)

用語を“孤立”させずに押さえたいときの参照本。「究極カンペ=頭の中のマップ」を作るとき、定義の揺れを潰すのに使いやすい。

https://amzn.to/4rtZXMR

ルールベース(探索・推論)と古典AI

人工知能の原理(Nils J. Nilsson 著 / 日本語訳あり)

「ルールベース→探索/推論」を、古典AIの文脈でちゃんと腹落ちさせたいときに向く(古いが骨格理解に効く)。

エージェントアプローチ人工知能 第2版(上と同じ)

探索・推論を含む“古典の柱”を、現代的な枠組みまでつなげて読める。

機械学習(教師あり/教師なし/特徴量/評価)

Pythonではじめる機械学習(Andreas C. Müller, Sarah Guido / オライリー・ジャパン)

「教師あり・教師なし・特徴量・モデル評価」を、実装とセットで整理できる。特に“特徴量=AIのメガネ”を手で理解するのに合う。

統計的学習の基礎 データマイニング・推論・予測(Hastie, Tibshirani, Friedman / 共立出版)

「万能解なし→課題適合が重要」を、統計的学習の視点で支える教科書。分類・回帰・モデル選択まで体系で押さえたい人向け。

パターン認識と機械学習 上/下(C. M. Bishop / 丸善出版)

教師あり・教師なしから確率モデルまで、機械学習の理論を“統一視点”で鍛えたいときの定番。矢印(教師なし→クラスタリング/次元削減)を厚くできる。

深層学習(ニューラルネット/重み/過学習と対策)

ゼロから作るDeep Learning(斎藤 康毅 / オライリー・ジャパン)

「ノード→ネットワーク→多層化→重み」「過学習→ドロップアウト」までを、手を動かして一本化できる。因果関係図と相性がいい。

深層学習(Ian Goodfellow ほか / KADOKAWA)

深層学習を“教科書として”押さえたいときに向く。深層パートを、数理・理論側から補強できる。

強化学習(報酬で学ぶ)

強化学習(第2版)(Sutton, Barto / 森北出版)

「強化学習=報酬で方策を学ぶ」を、基礎から現代トピック(AlphaGoなど)までつないで理解できる。

歴史(ブームと冬)を“波”で押さえる

REKIHAKU 特集・人工知能の現代史(国立歴史民俗博物館 ほか / 文学通信)

「波で覚える(第一次→第二次→冬→第三次)」を、技術史・社会史の観点から補助できる。技術だけでなく社会問題も含めて“現代史”として見たいときに合う。

未来議論(AGI→シンギュラリティ、2045年問題)

シンギュラリティは近い[エッセンス版](レイ・カーツワイル / NHK出版)

「AGI側の未来議論として置く」を、そのまま深掘りできる入口。まず薄く全体像をつかむ用途に向く。

シンギュラリティはより近く 人類がAIと融合するとき(レイ・カーツワイル / NHK出版)

“近い”の続編側。「2045年問題」など、未来予測の議論をもう一段読みたい人向け。

倫理・社会(AI効果と“当たり前化”を混ぜない)

AI・ロボットと共存の倫理(西垣 通 / 岩波書店)

「AI効果(高度化すると当たり前化してAIと呼ばれなくなる)」みたいな論点を、社会側の問いとして整理したいときに合う。

最短ルート 3冊+問題集

- エージェントアプローチ人工知能 第2版(Russell & Norvig / 共立出版)

- Pythonではじめる機械学習(Müller, Guido / オライリー・ジャパン)

- ゼロから作るDeep Learning(斎藤 康毅 / オライリー・ジャパン)

- 公式テキスト+問題集

コメント