その他の数理的なエッセイはこちら

- 要約(3行)

- なぜAIの文章はどれも似てしまうのか

- 肉付けとそぎ落とし:AI文章の二つの作り方

- ここが本題:小さく肉付けした文章と大きく削った文章が似てしまう

- 見抜く鍵:文章の上手さではなく「判断材料の痕跡」を探す

- 現象を整理する道具:品質の崖とボリューム制約

- CoreとPadding:削っても落ちない部分と落ちる部分

- 実務で効く運用:広げてから削るハイブリッド

- 実務チェックリスト:肉付けとそぎ落としの切り替え

- 補足:数式モデルとPython可視化

- FAQ

- 参考文献

- まとめ

- 生成AI×文章作成の実務(プロンプト/運用)

- 「AI時代でも自分で書く」+推敲の軸

- ロジカルライティング

- 要約・圧縮

- クリティカルシンキング/ファクトチェック

- ドキュメント/ナレッジ

- ガバナンス/法務/セキュリティ

要約(3行)

生成AIで文章の見かけ品質が揃うほど、書き手の中身の差は読み取りにくくなります。

小規模で低品質なメモを肉付けした文章と、大規模で高品質な原稿をそぎ落とした文章が「同じ」に見えることがあります。

判断基準・制約・捨てた案を残し、広げてから削るハイブリッド運用にすると安定します。

なぜAIの文章はどれも似てしまうのか

LLMの普及で、読みやすく整った文章を作ること自体は以前より簡単になりました。結果として起きるのが、文章の見かけ品質が一定ラインに収束しやすいという現象です。

この状況で注意したいのは、文章が読みやすいことと、その文章が書き手の中身(知識・判断基準・経験)を反映していることが、以前より切り離されやすい点です。

また、生成過程で起きる誤り(ハルシネーション)については概観として https://arxiv.org/abs/2202.03629 が参考になります。

肉付けとそぎ落とし:AI文章の二つの作り方

執筆プロセスを「ルート」として捉えると、見かけ品質と中身のズレを整理しやすくなります。

肉付けルート

核だけを出し、LLMで膨らませて文章を完成させるルートです。短時間で“それらしい”文章になりやすく、文章として成立するラインまで持ち上げやすいです。

一方で、膨らませる過程で、書き手の内側にない一般論・言い回し・論理の運びが混ざることがあります。文章が整っているほど、読み手からは書き手の実像より少し上振れて見えることがあります。

そぎ落としルート

素材を多めに出し、LLMで整理して短くするルートです。書き手が持っている素材の範囲内に寄りやすく、混入の幅が相対的に小さくなりやすいです。

一方で、出来上がる文章は「削って整えたもの」なので、書き手が持っているもののうち表に出るのは一部になります。読み手から見ると、文章は良いのに書き手の幅や奥行きが見えにくいことがあります。

ここが本題:小さく肉付けした文章と大きく削った文章が似てしまう

出発点が真逆でも、最終アウトプットがほぼ同じ文章に収束してしまうことがあります。これが「AI文章の手抜きは見抜けるのか」という問いを難しくします。

ルートA:小規模・低品質 → 肉付け

入力A(小さくて粗いメモ)

- 週次レポ作成がつらい

- AIで時短したい

- ミスは困る

出力A(肉付け後)

週次レポ作成の負荷を下げるため、生成AIを用いて下書きと要約を自動化します。

数値の根拠は元データに紐づけ、確認フローを設けて品質を担保します。

まずは小さく試し、作業時間と誤り率を指標に段階的に適用範囲を広げます。

ルートB:大規模・高品質 → そぎ落とし

入力B(本当は厚い原稿・議論がある)

- 誤りパターン別の対策(数字・固有名詞・解釈)

- 監査対応の根拠保持要件(参照リンク、変更履歴、責任分界)

- KPI設計(工数、再作業、レビュー時間、エラー分類)

- 代替案比較(検索/RAG、テンプレ固定、例外処理、ロールバック条件)

- 採否判断(やらない範囲、例外時の手戻り設計)

出力B(そぎ落とし後)

週次レポ作成の負荷を下げるため、生成AIを用いて下書きと要約を自動化します。

数値の根拠は元データに紐づけ、確認フローを設けて品質を担保します。

まずは小さく試し、作業時間と誤り率を指標に段階的に適用範囲を広げます。

この例が示すこと

出力A/Bはほぼ同じ“見かけ品質”に見えますが、裏側は同じとは限りません。

肉付けは「書き手の内側にない要素が混ざって整う」ことがあり、そぎ落としは「本来あった判断材料が削られて厚みが見えなくなる」ことがあります。

見抜く鍵:文章の上手さではなく「判断材料の痕跡」を探す

見かけ品質が収束すると、流暢さや整い方だけでは判定しづらくなります。そこで見るべきは、次のような判断材料の痕跡です。

- 判断基準:なぜその結論なのか、成功をどう測るのか

- 制約:何ができないのか、何をしないのか、前提は何か

- 捨てた案:なぜ他の選択肢を採らなかったのか

これらが文面に残っていると、読み手は「書き手の中身」にアクセスしやすくなります。逆に、これらが消えると、肉付けとそぎ落としの最終文が似ても区別がつきにくくなります。

現象を整理する道具:品質の崖とボリューム制約

ここからは、現象を手早く整理するための枠組みです。エンジニアリング用語に聞こえるかもしれませんが、言いたいことは単純です。

- 品質の崖:ある水準を超えると「文章として成立」しやすくなる一方、それ未満では弱い

- ボリューム制約:媒体・時間・読み手の集中力が許す範囲に量を収める必要がある

肉付けは、品質の崖を下から登る動きになりやすいです。

そぎ落としは、ボリュームを小さくする動きになりやすいです。ただし、削りすぎると品質の崖から落ちます。

CoreとPadding:削っても落ちない部分と落ちる部分

ボリュームと品質は別物にしたい一方で、現実には相関して見える区間があります。ここはボリュームを2つに分けると説明が通ります。

- Core(中身):論点・根拠・判断基準・制約など

- Padding(厚み):言い回し、冗長な言い換え、過剰な例示など

- Volume(量):中身+厚み

そぎ落としではPaddingから削れる限り、量は減っても品質が落ちにくく見えます。

そしてPaddingが尽きるとCoreに触れ始め、品質が落ちやすくなります。

肉付けではCoreを増やしたいつもりでもPaddingも増えやすく、量と品質が相関して見えやすくなります。

実務で効く運用:広げてから削るハイブリッド

二択ではなく、往復が成立します。

- いったん膨らませる(探索):幅を取り、候補を増やす

- 自分の型に合わせて削る(収束):芯だけ残して制約に収める

このとき、膨らませる段階の混入を「事故」にしないことが重要です。探索として意図的に広げ、収束で自分の判断基準に照らして採否を決めます。

そして最終文に、判断基準・制約・捨てた案のうち最低限を残すと、「似てしまう問題」に耐性がつきます。

実務チェックリスト:肉付けとそぎ落としの切り替え

肉付けに切り替える合図

- 論点が足りず、結論が弱い

- 根拠が薄く、読み手の疑問が先に立つ

- 構造が定まらず、説明が散る

そぎ落としに切り替える合図

- 伝えたいことは揃ったが、長い

- 同じ説明が形を変えて繰り返されている

- 例が多すぎて主題がぼける

崖落ちを防ぐために残すもの

- 判断基準(なぜその結論なのか)

- 制約(何ができないのか、何をしないのか)

- 捨てた案(何を採らなかったのか)

最低限のハルシネーション対策

- 一次情報(論文・規格・公的資料)に当たる

- 根拠の出典を文中に残す(URLを残す)

- 断言表現を条件付きに戻す

概観の出発点として https://arxiv.org/abs/2202.03629 が参考になります。

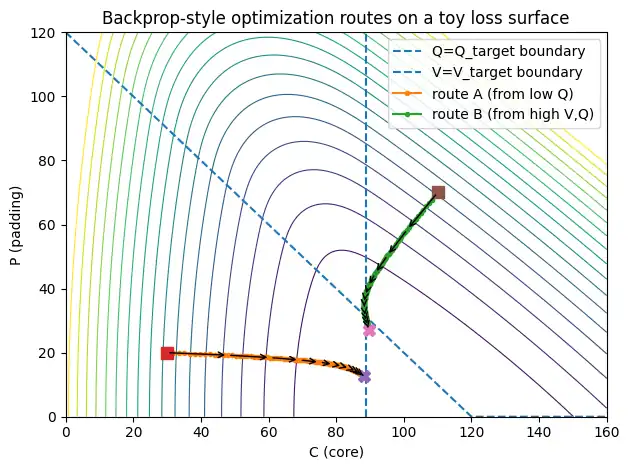

補足:数式モデルとPython可視化

この章の数式・コードは理解の補助です。読み飛ばしても記事として成立します。

品質の崖とボリューム制約を、2次元の最適化として眺めたい場合だけ参照してください。数式はMathJax想定で$…$記法です。

品質の崖の数式表現

品質$Q$がCore$C$に対して立ち上がるイメージを、シグモイドで置くと次の形になります。

$Q(C)=\displaystyle\frac{1}{1+\exp\left(-\displaystyle\frac{C-C_0}{\tau}\right)}$

目標品質$Q_t$を満たすための閾値Core$C_{th}$は次のように書けます。

$C_{th}=C_0+\tau\ln\left(\displaystyle\frac{Q_t}{1-Q_t}\right)$

損失面と最適化ルートのPython

以下のPythonは、Core$C$とPadding$P$の平面で「品質の崖」と「ボリューム制約」を満たす方向へ更新していく様子を等高線で可視化します。読み飛ばして問題ありません。

グラフは表示するだけのコードで、ファイル保存はしません。

import numpy as np

import matplotlib.pyplot as plt

def sigmoid_stable(x):

x = np.clip(x, -60, 60)

return 1 / (1 + np.exp(-x))

def soft_hinge(x, beta=10.0):

return np.logaddexp(0.0, beta * x) / beta

C0, tau = 80.0, 8.0

Q_t = 0.75

V_t = 120.0

C_thresh = C0 + tau * np.log(Q_t / (1 - Q_t))

wC, wV, wP = 12.0, 6.0, 3.0

sC, sV, sP = 40.0, 40.0, 60.0

beta = 10.0

def loss_and_grad(C, P):

V = C + P

xC = (C_thresh - C) / sC

xV = (V - V_t) / sV

shC = soft_hinge(xC, beta)

shV = soft_hinge(xV, beta)

L = wC * (shC ** 2) + wV * (shV ** 2) + wP * ((P / sP) ** 2)

dshC = sigmoid_stable(beta * xC) * (-1.0 / sC)

dshV = sigmoid_stable(beta * xV) * (1.0 / sV)

dL_dC = wC * 2 * shC * dshC + wV * 2 * shV * dshV

dL_dP = wV * 2 * shV * dshV + wP * 2 * (P / (sP ** 2))

return L, dL_dC, dL_dP

def gd_path(C_init, P_init, lr=2.0, steps=140):

C, P = float(C_init), float(P_init)

path = []

for _ in range(steps):

L, gC, gP = loss_and_grad(C, P)

path.append((C, P, L))

C -= lr * gC

P -= lr * gP

C = max(0.0, C)

P = max(0.0, P)

return np.array(path)

path_A = gd_path(30, 20)

path_B = gd_path(110, 70)

C_grid = np.linspace(0, 160, 240)

P_grid = np.linspace(0, 120, 200)

CC, PP = np.meshgrid(C_grid, P_grid)

VV = CC + PP

xC = (C_thresh - CC) / sC

xV = (VV - V_t) / sV

Lsurf = wC * (soft_hinge(xC, beta) ** 2) + wV * (soft_hinge(xV, beta) ** 2) + wP * ((PP / sP) ** 2)

levels = np.linspace(np.min(Lsurf), np.percentile(Lsurf, 92), 18)

plt.figure()

plt.contour(CC, PP, Lsurf, levels=levels, linewidths=0.8)

plt.axvline(C_thresh, linestyle="--", label="Q=Q_target boundary")

plt.plot(C_grid, np.clip(V_t - C_grid, 0, None), linestyle="--", label="V=V_target boundary")

plt.plot(path_A[:,0], path_A[:,1], marker="o", markersize=3, label="route A (from low Q)")

plt.plot(path_B[:,0], path_B[:,1], marker="o", markersize=3, label="route B (from high V,Q)")

def arrows(path, step=12):

for i in range(0, len(path)-step, step):

plt.annotate("", xy=(path[i+step,0], path[i+step,1]), xytext=(path[i,0], path[i,1]),

arrowprops=dict(arrowstyle="->", lw=1))

arrows(path_A, 12)

arrows(path_B, 12)

for p in (path_A, path_B):

plt.plot(p[0,0], p[0,1], marker="s", linestyle="None", markersize=8)

plt.plot(p[-1,0], p[-1,1], marker="X", linestyle="None", markersize=8)

plt.xlabel("C (core)")

plt.ylabel("P (padding)")

plt.title("Backprop-style optimization routes on a toy loss surface")

plt.legend()

plt.tight_layout()

plt.show()

FAQ

AI文章の手抜きは見抜けるのか

完全に見抜くのは難しいですが、流暢さではなく、判断基準・制約・捨てた案といった判断材料の痕跡を見ると精度が上がります。これらが残っているほど、書き手の中身にアクセスしやすくなります。

肉付けルートは悪い方法か

悪い方法ではありません。探索として早く形にできる利点があります。ただし、外部要素が混ざりやすいので、後段で「残すCoreのルール」を決めて選び直すと安定します。

そぎ落としルートだけなら安全か

相対的に混入が小さくなりやすい一方で、文章は縮小されるため、持っている幅や試行錯誤が見えにくくなることがあります。安全かどうかは目的と読み手の期待で決まります。

ハルシネーション対策は最低限何をすればよいか

一次情報(論文・規格・公的資料)に当たる、根拠のURLを文中に残す、断言表現を条件付きに戻す、の3点が最低限です。概観は https://arxiv.org/abs/2202.03629 が出発点になります。

参考文献

- NIST, “AI Risk Management Framework (AI RMF 1.0)”. https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Ji et al., “Survey of Hallucination in Natural Language Generation”. https://arxiv.org/abs/2202.03629

- Ouyang et al., “Training language models to follow instructions with human feedback”. https://arxiv.org/abs/2203.02155

- Wei et al., “Chain-of-Thought Prompting Elicits Reasoning in Large Language Models”. https://arxiv.org/abs/2201.11903

- Lewis et al., “Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks”. https://arxiv.org/abs/2005.11401

- Vaswani et al., “Attention Is All You Need”. https://arxiv.org/abs/1706.03762

まとめ

生成AIで文章の見かけ品質が揃うほど、小さく肉付けした文章と大きく削った文章が似てしまい、最終テキストだけでは裏側を見誤りやすくなります。

そこで、流暢さではなく判断材料の痕跡(判断基準・制約・捨てた案)を見ることが有効です。運用としては、探索(広げる)と収束(削る)を往復するハイブリッドが実務に馴染みます。

- 見かけ品質が揃うほど、肉付けとそぎ落としの最終文は似やすくなります。

- 見分けの鍵は、判断基準・制約・捨てた案といった判断材料の痕跡です。

- 広げてから削るハイブリッド運用で、混入と縮小の両方に耐性がつきます。

その他の数理的なエッセイはこちら

生成AI×文章作成の実務(プロンプト/運用)

ChatGPT はじめてのプロンプトエンジニアリング

生成AIプロンプトエンジニアリング入門 ChatGPTとMidjourneyで

10倍速で成果が出る!ChatGPTスゴ技大全

「AI時代でも自分で書く」+推敲の軸

生成AI時代にこそ学びたい 自分で文章を書く技術

新しい文章力の教室

日本語文章チェック事典

ロジカルライティング

ロジカル・ライティング

考える技術・書く技術

ロジカル・シンキング

要約・圧縮

理科系の作文技術

頭がよくなる!要約力

クリティカルシンキング/ファクトチェック

論理と感性を磨く!クリティカル・シンキング

FACTFULNESS(ファクトフルネス)

ファクトチェック ニッポン

情報を正しく選択するための認知バイアス事典

ドキュメント/ナレッジ

エンジニアのためのドキュメントライティング

ドキュメント・コミュニケーションの全体観

知識創造企業

ガバナンス/法務/セキュリティ

生成AI法務・ガバナンス

AIガバナンス入門

AIの法律

生成AIセキュリティの教科書

コメント