言語生成

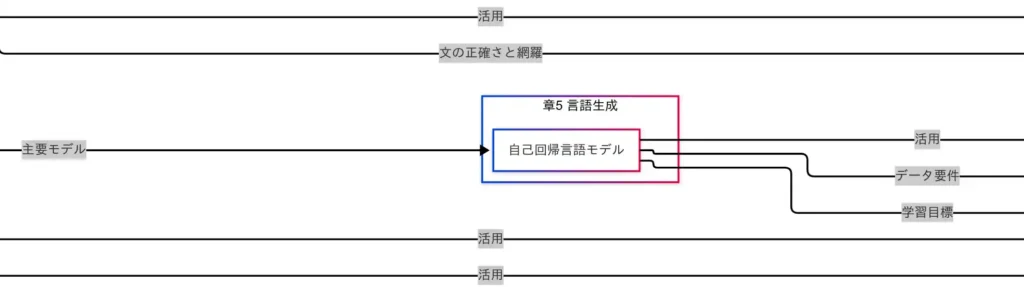

本章では、自己回帰言語モデル を中心に、言語生成の仕組み・要件・評価と主な応用を概観する。2D画像を直接合成するGANや拡散モデルと異なり、言語生成は 離散トークン列 を対象にし、次トークン予測 を逐次反復して文章を構成する点が核である。

学習原理:自己回帰と次トークン予測

- 目的:文脈 $x_{1:t-1}$ が与えられたときの条件付き確率 $p(x_t|x_1:t-1)$ を推定することである。

- 生成:開始トークンから確率分布に従いトークンを一つずつサンプリング(または貪欲・ビーム探索)し、列を延長していく。

- アーキテクチャ:現在は トランスフォーマ の自己注意機構が主流であり、広い文脈依存を効率的に扱える。

- 調整手法:事前学習後、微調整(教師あり・指示追従)、RLHF(人手フィードバックによる強化学習)等で望ましい振る舞いに近づける。

データ要件

- 大規模テキストコーパス:品質・多様性・ドメイン網羅性が性能を規定する。ノイズ除去や重複排除、毒性コンテンツの管理が重要である。

- タスク適応:専門領域では、追加コーパス や RAG(検索拡張生成) により、最新性・正確性を補強する。RAGは外部知識を参照してから生成するため、事実性 の改善に有効である。

評価指標

- 自動指標:BLEU/ROUGE は参照文との n-gram 類似で可読性・網羅性を近似的に測る。ただし意味理解や一貫性、事実性の完全評価は困難である。

- 人手評価:流暢さ、一貫性、関連性、事実整合性 等を評価軸として併用する。生成文の幻覚(hallucination)対策の観点でも不可欠である。

- 補助指標:タスク次第で METEOR、BERTScore、QAベース評価、毒性・バイアス指標などを用いる。

応用

- テキスト生成:記事作成、メール・レポート草案、クリエイティブライティング。

- 要約:ニュース・議事録の抽出/要約。

- 対話:アシスタント、カスタマーサポート、教育支援。

- 翻訳:ドメイン適応や品質推定と組み合わせた実運用。

- コード支援:補完、リファクタ、テスト生成。

- 情報アクセス:RAG による検索・質問応答の高精度化。

実務メモ

- デコード戦略:温度・トップk/p、ビーム幅の選択が 多様性-正確性 のトレードオフを左右する。

- 安全性:毒性・偏見・機密情報漏洩への対策(プロンプト制御、フィルタ、監査ログ)が必須である。

- 外部知識連携:RAG、ツール呼び出し、関数実行により、最新性・正確性・計算能力 を補完できる。

まとめ

自己回帰言語モデルは 次トークン予測 に基づき、大規模コーパス を前提として多様なNLPタスクを横断的に支える。評価は BLEU/ROUGE+人手評価 の併用が基本であり、実務ではRAG等で事実性と再現性を補強するのが定石である。次章では、ここまでに扱った各モデルの 学習のキーコンセプト を横断的に整理する。

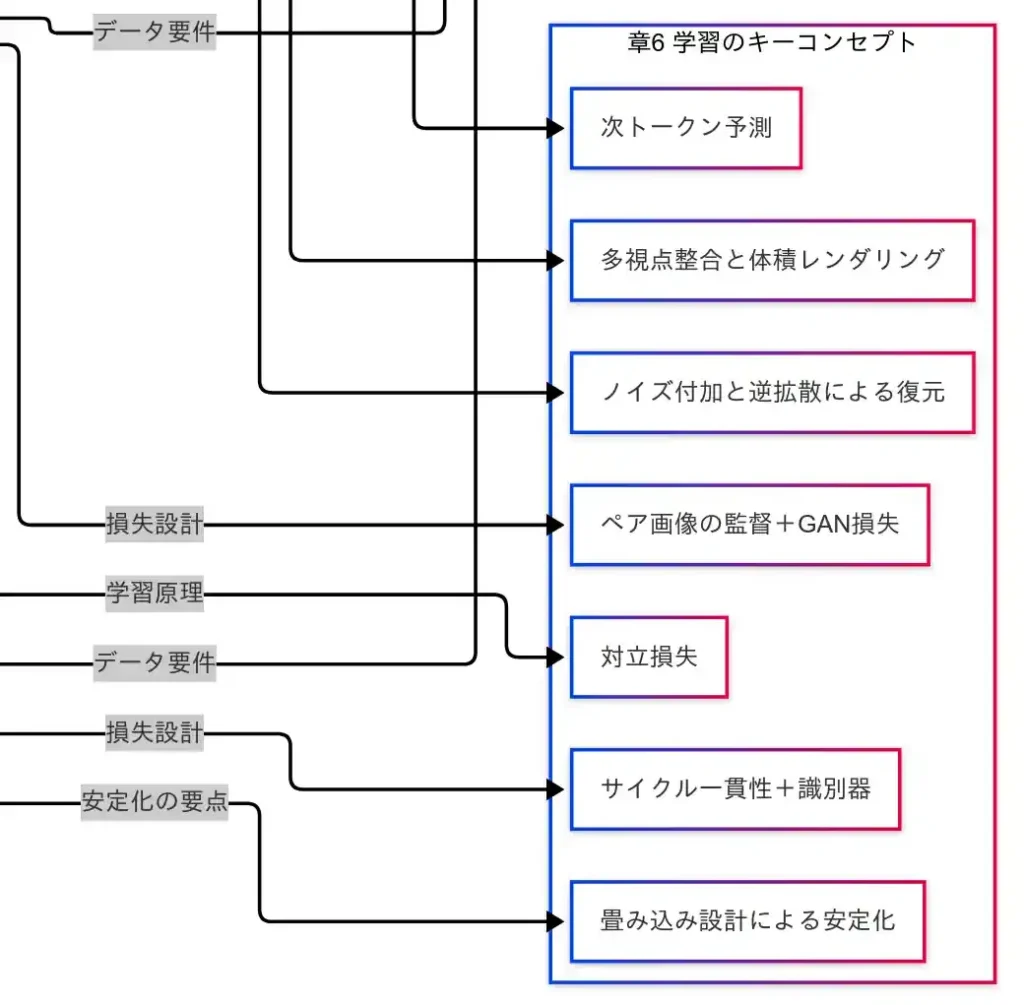

学習のキーコンセプト

本章では、各生成手法の 学習原理 を横断的に整理する。因果関係図で示したとおり、GAN、拡散モデル、NeRF、自己回帰言語モデルは、それぞれ異なる発想に基づく。違いを把握することが、モデル選定・評価設計・データ計画の出発点である。

GAN:対立損失(生成器×識別器の競争)

- 核:生成器 $G$ と識別器 $D$ が対立損失で競い合い、$G$ は $D$ を欺く方向に学習する枠組みである。

- 効果:鋭い局所的ディテールを持つサンプルを生成しやすい。

- 注意:学習不安定、モード崩壊のリスクがある。アーキテクチャ(DCGAN 等)や正則化で安定化を図る。

- タスク接続:新規画像生成、条件付き変換(Pix2Pix)、非ペア変換(CycleGAN)。

拡散モデル:ノイズ付加と逆拡散(確率的ノイズ除去の反復)

- 核:データに段階的に ノイズを付加 して完全ノイズ化し、その 逆過程(逆拡散)を学習してノイズを除去 し元分布へ戻す。

- 効果:学習が安定し、高画質・高忠実度 を達成しやすい。

- 注意:多段反復ゆえ 計算コスト が高い。潜在拡散やステップ短縮で高速化する。

- タスク接続:画像生成、超解像・インペインティング、音声波形・スペクトログラム生成、テキスト条件付き生成。

NeRF:多視点整合と体積レンダリング(空間の再現)

- 核:多視点画像と カメラ姿勢 を用いて、3D 空間の 放射輝度場(位置→密度・色)を学習し、体積レンダリング で任意視点画像を合成する。

- 効果:未観測視点でも幾何と見えの一貫性を保つ。

- 注意:多視点データ+正確な姿勢が必須。動的・非剛体には拡張手法が必要。

- タスク接続:3D/新規視点生成、AR/VR、デジタルツイン、シミュレーション。

自己回帰言語モデル:次トークン予測(逐次生成)

- 核:文脈 $x_{1:t-1}$ から 次トークン $x_t$ の条件付き確率を予測し、逐次的に列を延長する。

- 効果:長い文脈の依存を扱い、汎用タスク(要約・対話・翻訳・コード)に適用可能である。

- 注意:大規模コーパス が前提。自動指標では意味・事実性を測り切れないため、人手評価や RAG 併用が実務的である。

- タスク接続:テキスト生成、要約、対話、翻訳、コード支援、検索拡張生成(RAG)基盤。

横断比較:発想の違いを一言で

- GAN=競争 で本物らしさを引き上げる。

- 拡散=ノイズ掃除 を繰り返して高品質化する。

- NeRF=空間を再現 してから任意視点へ投影する。

- 言語=逐次予測 で離散列を組み立てる。

実務で効くチェックリスト

- 安定性が最優先か → 拡散モデルを検討。

- リアルタイム・低遅延が要るか → GAN系や蒸留済み拡散(ステップ短縮)を検討。

- ペア画像は用意できるか → Yes: Pix2Pix、No: CycleGAN。

- 視点変更が主目的か → NeRF。データ撮影計画とキャリブレーションを最初に固める。

- 事実性・最新性が重要か → 言語モデル+RAG、人手評価フローを設計する。

以上で学習原理の地図を共有した。次章では、この原理に対応する データ要件 を具体化し、収集・アノテーション計画の勘所を整理する。

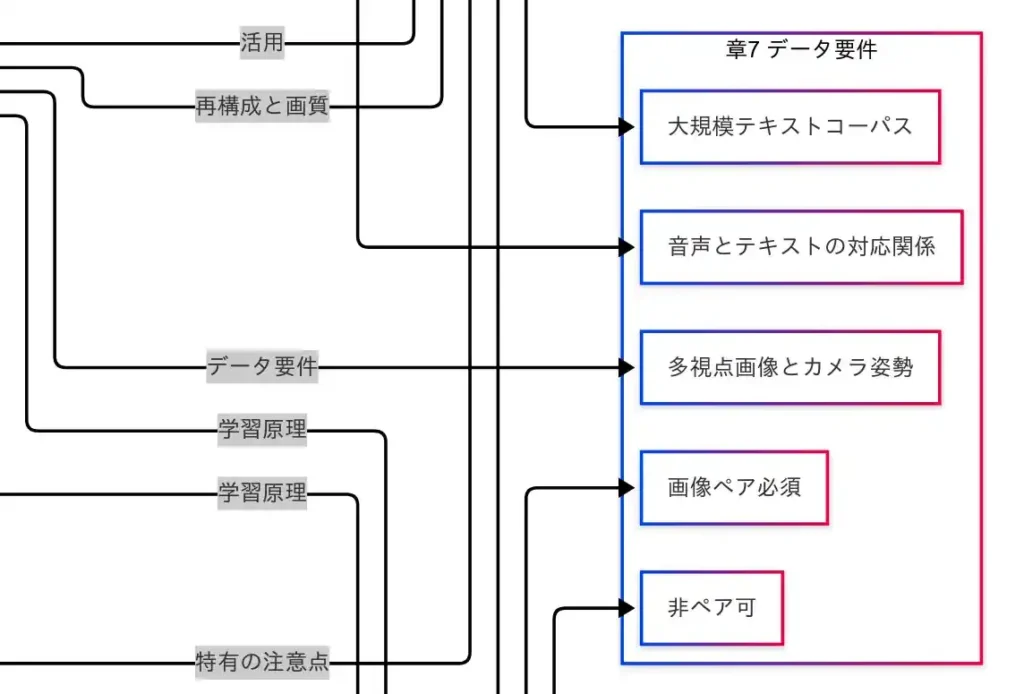

データ要件

本章では、各手法が成立するために必要な データの前提条件 を整理する。因果関係図のとおり、要件はモデル設計と密接に結び付いており、収集・アノテーション計画の可否がモデル選定を左右する。

画像対画像変換(Pix2Pix/CycleGAN)

- Pix2Pix:ペア画像必須

入力と正解の 1対1対応(例:スケッチ⇔対応写真、白黒⇔同一構図のカラー)が必要である。位置合わせや露出差が大きいと損失が不安定化するため、厳密なアライメント と 十分な枚数 が前提である。 - CycleGAN:非ペア可

ドメインA・Bそれぞれの 非対応コレクション で学習できる。データ収集は容易になるが、幾何や色の アイデンティティ保持 が崩れやすいため、被写体分布や前処理(色統一、クロップ一貫化)を計画するべきである。

画像生成(GAN/拡散モデル)

- 量と多様性

クラスバランス、構図・照明・背景の偏りを抑えた 大規模・多様データ が望ましい。偏りは モード崩壊 や汎化不足の温床となる。 - 前処理

解像度統一、標準化、軽微なデータ拡張の設計が安定化に寄与する。拡散モデルでは キャプション品質(テキスト条件付けの場合)が生成忠実度を左右する。

3D/新規視点生成(NeRF)

- 多視点画像+カメラ姿勢(必須)

視差を十分に含む 多視点画像群 と 正確な外部・内部パラメータ が必要である。姿勢誤差はゴーストやブレとして顕在化する。 - 撮影計画

覆い(カバレッジ)とベースライン(カメラ間距離)の設計、露出・ホワイトバランスの一貫化、反射・透過物体の扱いが品質を左右する。動的シーンは静止化または拡張手法の導入が前提である。

言語生成(自己回帰言語モデル)

- 大規模テキストコーパス

品質(正確性・文体多様性)とスケールが性能の上限を規定する。重複排除、毒性・機密情報の除去などクレンジングが前提である。 - ドメイン適応

専門分野では追加コーパスや RAG で外部知識を参照し、最新性・事実性を補う設計が必要である。

音声生成(TTS/声質変換/歌声)

- 音声-テキスト対応

音素・単語レベルでの アライメント が重要である。録音品質(無反響・SNR)、話者バリエーション、発話スタイルの網羅が自然性に直結する。 - メタデータ

話者ID、話速・感情ラベルなどの リッチな付帯情報 は制御性向上に有効である。

実務チェックリスト

ペアを用意できるか → 可能:Pix2Pix/不可:CycleGAN。

視点変更が主目的か → NeRF、撮影計画とキャリブレーションを先に固める。

大規模・多様データを確保できるか → GAN/拡散の品質・多様性のボトルネックとなる。

機密・権利・個人情報 → 収集時のライセンス確認、匿名化・合成データ併用の方針策定が必須である。

以上より、「使いたいモデル」ではなく「用意できるデータ」から逆算 して手法を選ぶのが合理的である。次章「評価指標」では、これらの前提の上に 生成品質をどう測るか を定義する。

コメント