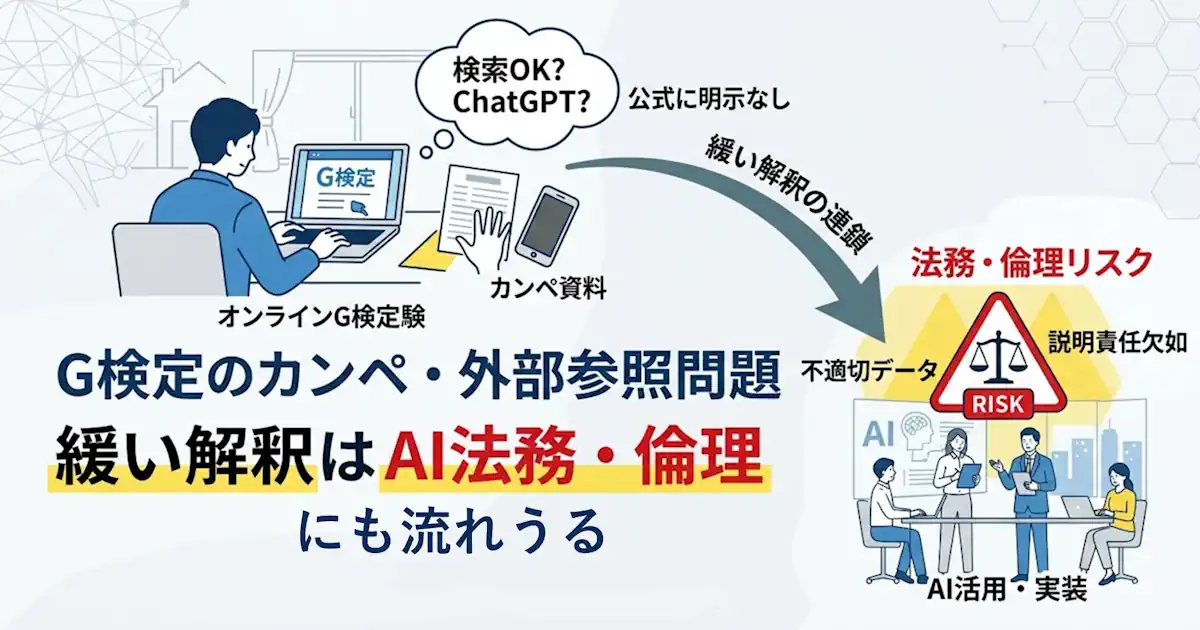

- G検定の論点はカンペ可否だけでなく、曖昧な場面で緩い方へ流れる判断にある

- その判断は受験だけで終わらず、AI法務・倫理でも再現されうる

- しかもこれは個人の問題というより、受験産業と企業内AI推進が生みやすい構造の問題でもある

合わせて読むことおすすめの記事

G検定まとめ記事

まず原則としてカンペ禁止ととらえた方が妥当とみる(安全側、公式の検出対応変化リスク)

難化体感(作問由来)

難化体感(暗記ゴールと設定してしまう構造的原因)

問題集の使い方

カンペという言葉の再定義と作り方

シラバスを漏れ検知器へ

結論

G検定のカンペ・外部参照問題で本当に気になるのは、カンペが許されるのかどうかだけではありません。

もっと気になるのは、曖昧な場面で自分に有利な緩い解釈へ流れていく判断そのものです。

JDLA公式のG検定ページでは、G検定は「AI・ディープラーニングの活用リテラシー習得のための検定試験」と案内され、出題範囲には「法律・倫理分野」や「AI倫理・AIガバナンス」も明記されています。つまり、G検定は技術だけの試験ではなく、AIの社会実装やガバナンスも含めて学ぶ資格として置かれています。

その一方で、少なくとも公開情報として確認できる範囲では、「外部参照OK」「ChatGPT利用OK」と安心して受け止められるJDLAの明示は見当たりませんでした。公開されている受験当日マニュアルでは、試験開始前に受験規約への同意が必要とされ、JDLAの告知では、受験サイト利用規約第8条に基づき、試験問題の全部もしくはその一部について漏えいにつながる一切の行為やそのおそれのある行為が禁止されています。受験者としては、明確に許容を確認できない以上、安全側で考える方が自然です。

そして、ここがいちばん重要です。

G検定のカンペ・外部参照問題で緩い方に流されることは、AI法務やAI倫理でも緩い方に流されうる、ということです。受験の場だけ都合よく緩くなり、実務では急に慎重になると考える方が、むしろ不自然です。

前提

この記事は、特定の個人や特定の記事を攻撃するためのものではありません。

そうではなく、G検定のカンペ・外部参照問題にまとわりつく、なんとも言えない違和感を、個人批判ではなく構造の話として言葉にしたいだけです。

そして、この問題は私自身も無関係ではありません。

構造の問題である以上、私自身もまた、その流れの外にはいないからです。

実際、G検定という受験産業や周囲の空気に最適化された結果として、弊サイト内のG検定対策記事も、その影響を受けているはずです。

「G検定で問われるのはせいぜいこのあたりだろう」という、合格に寄った楽観的な考えが、どこかに入っていた可能性はあります。

法的・倫理的なリスクの重さとは距離がありますが、あるべき姿から見れば、少々雑だったかもしれません。

だからこれは、だれかを安全圏から批評するための文章ではありません。

むしろ、自分も含めて、どこで判断が緩い方へ流れやすいのかを見つめ直すための文章です。

公開情報ベースでG検定のカンペ可否を整理した前提記事として、G検定でカンペはNGと受け取る方が妥当と考える記事があります。

本記事はそこから一歩進めて、「なぜこの違和感がAI法務・AI倫理・AIガバナンスの感覚にまでつながって見えるのか」を考えます。

G検定で公式に確認できること

まず押さえておきたいのは、JDLAの公開情報で何が確認でき、何が確認できないかです。

確認できるのは、G検定がJDLA実施のAI・ディープラーニング活用リテラシーの検定であること、オンライン実施の自宅受験であること、そして出題範囲に法律・倫理分野やAI倫理・AIガバナンスが含まれていることです。つまり、G検定は技術知識だけを問う資格ではありません。

一方で、確認した公開情報の範囲では、「G検定はカンペOK」「G検定は検索OK」「G検定はChatGPT利用OK」といった明示は見当たりませんでした。公開マニュアルが示しているのは、試験前の確認事項と試験開始までの操作手順です。さらにJDLAの告知では、受験サイト利用規約第8条の禁止行為として、試験問題の全部もしくはその一部について、漏えいにつながる一切の行為またはそのおそれのある行為が挙げられています。

この状態で、「たぶん大丈夫」「書いていないなら問題ない」と読むのは、かなり緩い側の判断です。

少なくとも、安全側で考える態度とは言いにくいです。

インパクト差と判断様式

もちろん、G検定のカンペ・外部参照問題と、AI法務・倫理の問題は、結果として生じうるインパクトが同じではありません。

後者の方が、組織や社会への影響が大きい場面は多いはずです。

この違いを無視したいわけではありません。

実際、対象が変われば考え方を切り替えられる人もいるでしょう。

ただ、厄介なのは、どちらも判断の瞬間にはインパクトが見えにくいことです。

カンペ・外部参照の可否も、その時点では「本当にまずいのか」「どこから問題になるのか」が見えにくい。AI法務・倫理も同じで、その時点では「どこまでリスクがあるのか」「あとでどれだけ重く効くのか」が見えにくいことが多いです。だから、まずは同じ平面で見た方が妥当です。結果の重さではなく、曖昧な場面で何を基準に判断するか、という点で見るべきだからです。

G検定で緩い方へ流れる感覚は、AI法務・倫理でも再現されうる

G検定のカンペ・外部参照問題で気になるのは、資料を見るかどうかだけではありません。

本当に気になるのは、曖昧な場面に出会ったとき、自然にどちらへ判断が流れるかです。

少なくとも、明確に許容を確認できない行為に対して、「多分大丈夫」「明示禁止ではない」「みんなやっていそう」と読むのは、緩い側の判断です。

そして、この判断は受験の場だけに閉じたものではありません。

むしろ、判断の癖として他の場面にも持ち込まれやすいです。

AI法務やAI倫理の実務では、毎回きれいに白黒が書かれているわけではありません。

むしろ多いのは、ルールの趣旨、説明責任、レピュテーション、利用者保護、組織としての妥当性まで含めて考えなければならない場面です。総務省・経済産業省のAI事業者ガイドラインでも、リスクベースアプローチ、透明性、アカウンタビリティ、AIリテラシーの確保などが重視されています。

つまり、AI法務やAI倫理で必要なのは、「明示禁止がないから進める」という感覚ではなく、「曖昧なら慎重に考える」という感覚です。

だから、G検定のカンペ・外部参照問題で緩い方へ流れることは、単なる受験上の小さな癖ではありません。

その感覚は、AI法務やAI倫理でも緩い方へ流れうる感覚として見るべきです。

実務で現れやすい具体例

ここで言いたいのは、G検定のカンペ・外部参照問題と、実務上の法務・倫理判断が同じ重さだということではありません。

ただ、曖昧な場面で緩い方へ流れる判断様式は、実務でもかなり似た形で現れます。

その意味で、受験の場で見える緩さは、実務とは無関係とは言いにくいです。

たとえば、社内PoCの段階で法務確認を後回しにする場面があります。

まだ検証段階だから、まだ小さい取り組みだから、まず動かしてから考えればよい。

そうした判断は、一見すると機動的に見えます。

ただ、ここでも働いているのは、「今のところ明確に止められていないから先に進める」という感覚です。

この感覚は、G検定のカンペ・外部参照問題で「明示的にダメと書いていないなら大丈夫ではないか」と読む感覚とかなり近いです。

たとえば、学習データや参照データの扱いでも同じです。

データの出所、利用許諾、再利用範囲、個人情報や著作権の論点が十分に整理されていないのに、「明示禁止がないから」「社内利用だから」「学習用だから」という言い方で進めようとすることがあります。

しかし、法務や倫理で本来必要なのは、その場で禁止されているかどうかだけではなく、利用の妥当性、説明責任、あとで問題化したときの耐性まで含めた検討です。

ここでもやはり、緩い方へ流れる判断様式が見えます。

たとえば、社内説明資料や稟議資料で、リスクの記載を薄くしすぎる場面もあります。

導入効果や業務改善の話は厚く書く一方で、データ管理、バイアス、説明可能性、契約、利用条件、外部提供時の留意点などは数行で流してしまう。

これもまた、まだ表面化していないリスクを軽く扱うという意味でかなり連続しています。

見えていないリスクを先回りして重く見るのではなく、今は大丈夫そうだから薄く処理する。

この癖は、受験でも実務でも同じ方向を向いています。

もちろん、対象が受験から実務に変われば、そこで思考を切り替えられる人もいるでしょう。

ただ、実際には、どちらも判断時点ではインパクトが見えにくいまま処理されやすいです。

だからこそ、受験の場で緩い方へ流れる判断は、実務とは別物だと安心しすぎない方がよいと思います。

受験産業は合格に最適化されやすい

ここで見たいのは、特定の受験者の人格ではありません。

むしろ問題は、緩い判断を生みやすい構造の方にあります。

受験産業である以上、まず起きやすいのは合格への最適化です。

何が妥当かより、何が通りやすいかが前に出やすい。

何を学ぶかより、どう受かるかが先に立ちやすい。

この傾向そのものは、受験産業ではごく自然です。

ただ、その延長で「どこまでやってよいのか」まで合格最適化の発想で読まれ始めると、かなり危うくなります。

本来なら、曖昧な場面ほど規約の趣旨や信頼性を見るべきです。

それなのに、「受かればいい」「明示禁止でなければいい」という読み方が入り込むと、判断の軸がかなり変わってしまいます。

見るべきなのは、そのような読み方を個人の性格だけで説明することではありません。

そうした読み方が自然に生まれやすい受験構造の方です。

AI資格は技術の印象が強く、法務倫理は後ろに回りやすい

JDLAの公式シラバスには、法律・倫理分野やAI倫理・AIガバナンスが明記されています。

つまり、G検定の設計そのものは、法務や倫理を脇役に置いていません。

それでも、受験者の体感では、AI資格はどうしても技術の印象が先に立ちやすいです。

AIという言葉には、モデル、精度、実装、活用といったイメージが強くついているからです。

その結果、法務や倫理は重要だと頭ではわかっていても、判断原理というより「出題範囲の一部」として扱われやすくなります。

ここがかなり大きいと思います。

法務や倫理は、本来、便利さや効率より先に効くものです。

ところが受験の場では、合格に直接つながるものの方が前に出やすい。

すると、AI倫理やAI法務は学ぶ対象ではあっても、自分の判断を律する基準としては弱くなりやすいのです。

G検定合格者が社内のAI説明役になる流れ

JDLAのG検定ページには、合格者インタビュー、合格者アンケート結果、キャリアアップ事例などの導線があります。ここから、G検定が個人学習だけでなく、合格後の活用や社内展開ともつながりやすい資格として扱われている、と読むことは十分できます。

企業でAI活用を進める場面では、G検定合格者が社内の初期説明役になる流れはかなり自然です。

制度として明文化されていなくても、「資格を持っている人」「先に学んだ人」に、AIの基本や注意点の説明が集まりやすいからです。

このような流れを持つ企業は、おそらく多いでしょう。

しかもAI導入の初期段階では、技術、法務、倫理、ガバナンスの担当がきれいに分かれていないことも珍しくありません。

そのため、G検定合格者がAIの概要だけでなく、AI倫理やAI法務まで含めて“社内のわかる人”として扱われることがあります。

だからこそ、受験時の判断姿勢は受験会場だけにとどまりません。

あとで社内に流れ込みうるのです。

G検定でChatGPTや検索を考えるときの違和感

G検定でChatGPTや検索を使ってよいのか、という問いが出てくるのは自然です。

ただ、少なくとも確認したJDLAの公開情報では、そうした利用を積極的に許容する明示は見当たりませんでした。公開マニュアルが示しているのは試験開始までの手順であり、別の告知では試験問題の漏えいにつながる行為等が禁止されています。

ここで大事なのは、最終的な白黒の結論だけではありません。

もっと大事なのは、明確に許容を確認できない場面で、どういう方向へ判断が流れるかです。

「便利だから」「今どき普通だから」「みんなやっていそうだから」という方向へすぐ傾くなら、その感覚はかなり危ういです。

この危うさは、受験マナーの問題として片づきません。

なぜなら、その人が別の場面ではAI法務やAI倫理を説明する側に回るかもしれないからです。

そして、そのときにも同じ感覚で「明示禁止がないなら大丈夫では」と語り始めたら、話は一気に重くなります。

AIガバナンスの縮図

総務省・経済産業省のAI事業者ガイドラインでは、AIリスクの多様化・増大を前提に、事業者がリスクを正しく認識し、ライフサイクル全体で必要な対策を進めること、そしてリスクベースアプローチが重要であることが示されています。あわせて、透明性、説明、文書化、教育・AIリテラシーの重要性も明確にされています。

ここから逆算すると、G検定のカンペ・外部参照問題が気持ち悪く見える理由もはっきりします。

AI法務やAI倫理で必要なのは、明示禁止の有無だけを見る感覚ではなく、趣旨、説明責任、リスク、事業価値まで含めて考える感覚だからです。

それなのに、受験の場で緩い方へ自然に流れてしまうなら、その感覚はAIガバナンスの方向とかなり反対を向いています。

だからこの論点は、受験上の細かな話ではありません。

受験の中に、企業のAIガバナンス全体の縮図が見えてしまう。

そこに、この話の不気味さがあります。

まとめ

G検定のカンペ・外部参照問題で本当に見るべきなのは、カンペがOKかNGかだけではありません。

曖昧な場面で、趣旨とリスクを見るのか、それとも自分に有利な緩い解釈へ流れるのかです。

そして、この点は受験だけの話では終わりません。

G検定のカンペ・外部参照問題で緩い方に流されることは、AI法務やAI倫理でも緩い方に流されうるからです。

インパクトの大きさは同じではなくても、判断の瞬間にはどちらも影響が見えにくい。

だから、まずは同じ平面で見た方が妥当です。

たとえば、社内PoCで法務確認を後回しにする、学習データの扱いを「明示禁止がないから」で進める、社内説明資料でリスクを薄く流す。

こうした実務上の緩さは、受験時の判断様式と完全に無関係とは言いにくいです。

違和感の矛先を向ける先は、特定の個人ではありません。

受験産業の合格最適化、AI資格の技術偏重、資格取得者の社内説明役化。

こうした流れが重なることで、曖昧な場面に緩い解釈が入り込みやすくなる。

見るべきなのは、その構造の方です。

- G検定で緩い方へ流れる感覚は、AI法務・倫理でも再現されうる

- 問題は個人より、緩い判断を生みやすい構造にある

- 受験の小さな緩さが、社内のAI説明へ流れ込みうる

FAQ

G検定はカンペOKなのか

少なくとも確認したJDLAの公開情報や受験操作マニュアルの範囲では、「カンペOK」と安心して受け止められる明示は見当たりませんでした。

そのため、受験者としてはOK前提で考えない方が安全です。

G検定は外部参照OKなのか

少なくとも確認した公開情報では、「外部参照OK」と積極的に案内する明示は見当たりませんでした。

明確に許容を確認できない以上、安全側で考えるのが自然です。

G検定でChatGPTを使ってもよいのか

少なくとも確認した公開情報では、本試験中のChatGPT利用を積極的に許容する明示は見当たりませんでした。

そのため、試験中の利用を前提にしない方が無難です。

なぜG検定のカンペ問題がAI法務やAI倫理につながるのか

理由は、どちらも曖昧な場面での判断が本体だからです。

G検定のカンペ・外部参照問題で緩い方へ流れることは、AI法務やAI倫理でも緩い方へ流されうる感覚として見た方が妥当です。

受験の緩さと実務の緩さは本当に関係あるのか

完全に同じ問題だとは言えませんが、判断様式としては連続しています。

たとえば、社内PoCで法務確認を後回しにする、学習データの扱いを「明示禁止がないから」で進める、社内説明資料でリスクを薄く書くといった場面には、曖昧なところを緩い方へ読む感覚が表れやすいです。

なぜ個人批判ではなく構造の話にするのか

問題の本体が、だれか一人の人格ではなく、合格最適化、技術偏重、社内説明役化という流れにあるからです。

個人を指さすより、その流れを見た方が本質に近づけます。

参考文献

一般社団法人日本ディープラーニング協会「G検定とは」

https://www.jdla.org/certificate/general/

JDLA試験事務局「G検定受験サイト受験当日の操作マニュアル」

https://docs.jdla-exam.org/OperationManual_Examinees_JP.pdf

一般社団法人日本ディープラーニング協会「【お知らせ】G検定過去問の無断販売およびその対応について」

https://www.jdla.org/news/%E3%80%90%E3%81%8A%E7%9F%A5%E3%82%89%E3%81%9B%E3%80%91g%E6%A4%9C%E5%AE%9A%E9%81%8E%E5%8E%BB%E5%95%8F%E3%81%AE%E7%84%A1%E6%96%AD%E8%B2%A9%E5%A3%B2%E3%81%8A%E3%82%88%E3%81%B3%E3%81%9D%E3%81%AE%E5%AF%BE/

総務省・経済産業省「AI事業者ガイドライン(第1.1版)」

https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/20240419_report.html

ど真ん中の2冊

『生成AI法務・ガバナンス 未来を形作る規範』

生成AIのリスク、個人情報、機密情報、著作権、契約、会社経営、AI倫理、各国規制、社内ルールや体制整備までかなり広く押さえていて、「技術の便利さ」ではなく「どう統治するか」に軸足がある。

「緩い判断は受験だけで終わらず、社内の法務・倫理説明にも流れうる」という線を、最も実務寄りに補強しやすい。

『AI倫理 人工知能は「責任」をとれるのか』

こちらは実務ハンドブックというより、責任、監視、差別的選別、創作、自動運転のような論点を通して、「AIで何が問題になるのか」を倫理側から考える本。

「便利だから使う」と「責任をどう考えるか」は別だ、という感覚を立てやすい。

実務の論点に降ろす2冊

『生成AIと知財・個人情報Q&A』

実務寄りでかなり使いやすい。

知財、個人情報、肖像権、秘密情報、プロンプト入力、海外ベンダー利用、社内規程など、現場で実際に迷いやすい論点がQ&Aで並んでいるので、この記事の中で挙げていた「学習データの扱いを明示禁止がないからで押し切る」「法務確認を後回しにする」といった場面にそのまま接続しやすい。

『新・個人情報保護法の逐条解説』

個人情報まわりを雑に語りたくないなら強い。

記事の中でいちばん実務事故につながりやすいのは、実は個人情報やデータ利用の軽視なので、そこを厳密にしたいならこの本が効く。

令和2年・令和3年改正対応で、法文ベースで腰を据えて確認したいとき向き。

読みやすさより、判断の精度を上げるための本。

「AIと法」を広く見たいなら

『ロボット・AIと法』

この記事はかなり批評的なので、少し視野を広げるならこれがよい。

現在起きている問題から近未来の問題までを見渡して、法学からどう考えるかを示す本で、JDLAの推薦図書にも挙がっている。

記事の「G検定の小さな判断の中に、AIガバナンス全体の縮図が見える」という感覚を、より広い法的地図の中に置き直せる。

『AIと法』

こちらは論考寄り。

AI社会における自律、プライバシー、監視・見守り、ガバナンス、中国でのAI実装など、テーマごとに考える本。

実務の即戦力というより、「なぜこの違和感があるのか」を法哲学や社会の側から補強したいときに向く。記事の思想的な背骨を太くする用途。

構造批判を強くしたいなら

『法律実務家のためのコンプライアンスと危機管理の基礎知識』

「個人ではなく構造が問題」という線を、いちばん別角度から支えてくれる本。

コンプライアンスの要点だけでなく、企業不祥事後の危機管理、サイバー、品質不正、個人情報保護、営業秘密、ビジネスと人権まで含んでいて、「なぜ組織は緩い判断を生むのか」「なぜ後回しが事故になるのか」を実務感覚で考えやすい。

AIリテラシーと技術偏重のズレを見たいなら

『[改訂新版]はじめてのAIリテラシー』

MDASHの2024年改訂に対応した入門書で、AIの仕組み、限界、注意点、社会的な変化まで広く扱っている。

この記事の「AI資格は技術の印象が強く、法務倫理は後ろに回りやすい」という論点を、教育・リテラシーの側から見る材料になる。

まず買うならこの順番

- 1冊目: 『生成AI法務・ガバナンス 未来を形作る規範』

- 2冊目: 『生成AIと知財・個人情報Q&A』

- 3冊目: 『法律実務家のためのコンプライアンスと危機管理の基礎知識』

- 4冊目: 『AI倫理 人工知能は「責任」をとれるのか』

コメント