バックナンバーはこちら

3行要約

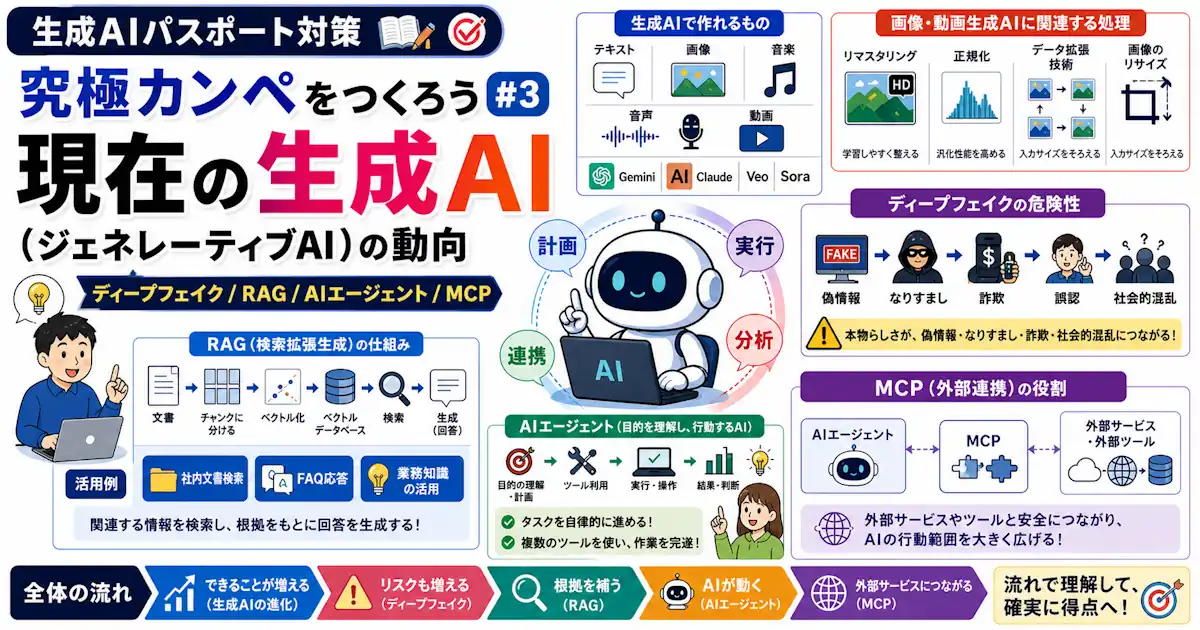

- 生成AIは、文章だけでなく画像・音声・動画まで作れる技術へ広がっています。

- 便利になるほど、ディープフェイクやなりすましなどのリスクも大きくなります。

- RAG、AIエージェント、MCPを流れで理解すると、現在の生成AIの全体像が整理しやすくなります。

解説動画

※ 近日(5/9中)公開

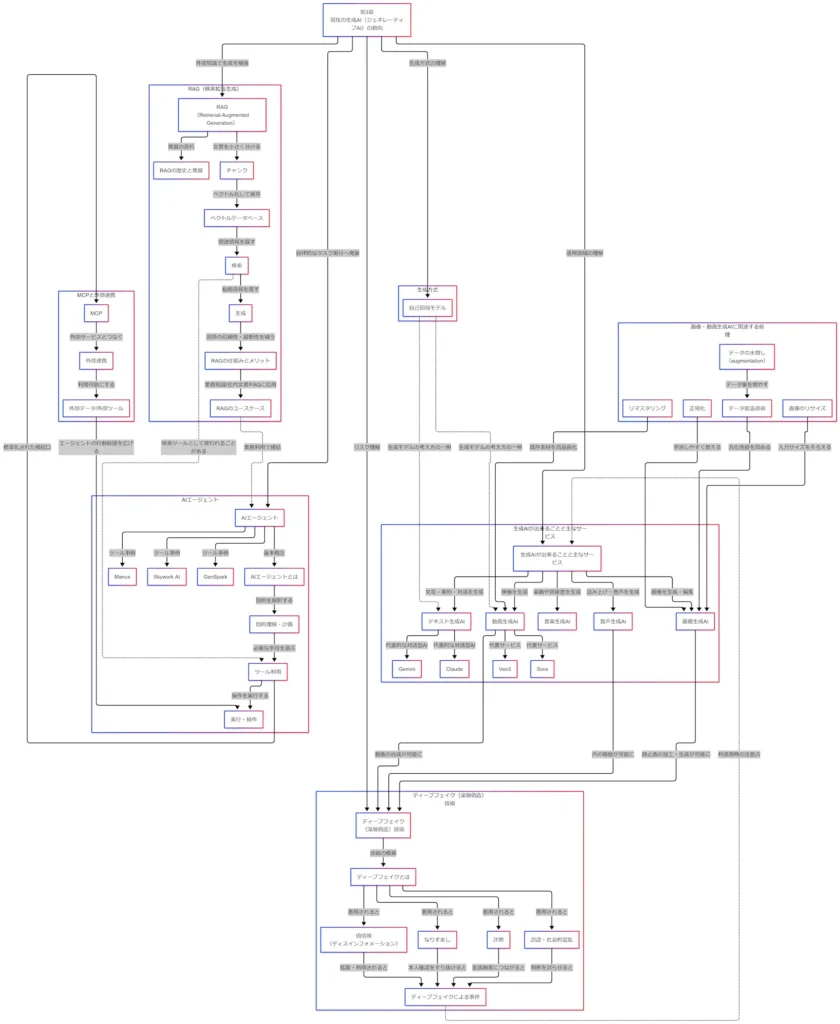

生成AIの現在地

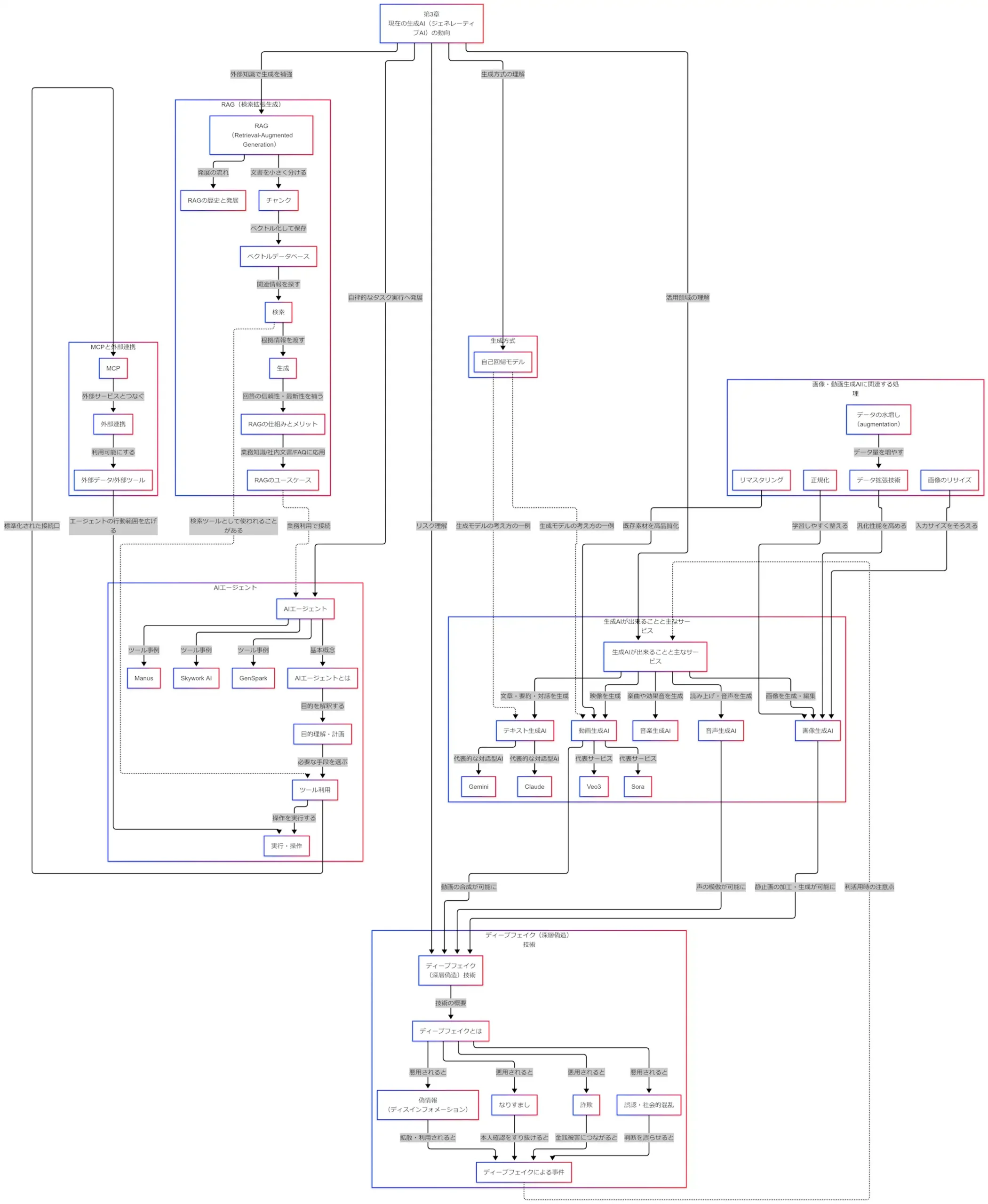

生成AIは、文章を作るだけの技術ではありません。現在は、テキスト、画像、音楽、音声、動画まで、さまざまな形式のコンテンツを生成できるようになっています。

生成AIパスポート対策では、個別サービス名を暗記するよりも、「何を生成するAIなのか」で整理することが大切です。ClaudeやGeminiはテキスト生成AIの代表例として、SoraやVeoは動画生成AIの代表例として置くと理解しやすくなります。OpenAIはSoraを動画生成モデルとして説明し、Google DeepMindもVeoを動画生成モデルとして紹介しています。(OpenAI Help Center)

生成AIの動向は、次の5つに分けると見通しがよくなります。

- 生成AIで作れるもの

- 画像・動画生成AIに関連する処理

- ディープフェイクの危険性

- RAGによる外部知識の活用

- AIエージェントとMCPによる外部連携

この順番で見ると、「できることが増える」「リスクも増える」「根拠を補う」「AIが動く」「外部サービスにつながる」という流れが見えてきます。

生成AIで作れるもの

生成AIで作れるものは、大きく分けると次の5種類です。

- テキスト

- 画像

- 音楽

- 音声

- 動画

テキスト生成AIは、文章作成、要約、翻訳、対話、アイデア出しなどに使われます。ClaudeやGeminiのようなAIアシスタントは、この分野の代表例として押さえるとよいです。Claudeは文章作成や分析などを支援するAIアシスタントとして提供され、Geminiも文章作成、計画、調査、学習などを支援するAIアシスタントとして提供されています。(Claude)

画像生成AIは、プロンプトから画像を作ったり、既存画像を編集したりする用途で使われます。音楽生成AIは、楽曲や効果音の作成に使われます。音声生成AIは、読み上げ、ナレーション、音声合成などに使われます。動画生成AIは、テキストや画像から映像を作る用途で使われます。

生成AIパスポート対策では、「サービス名」だけを追うと混乱しやすくなります。まずは、どの生成物を扱うAIなのかを先に置くことが重要です。

生成方式と自己回帰モデル

生成AIを理解するとき、自己回帰モデルも関連します。

自己回帰モデルは、前の情報をもとに次の要素を順番に予測していく考え方です。テキスト生成では、前の単語や文脈をもとに次の単語を予測します。動画生成でも、時間の流れを意識して次の状態を作る考え方につながります。

ここで大切なのは、生成AIが「一度に何かを出す魔法」ではなく、文脈や条件をもとに出力を組み立てる仕組みだと見ることです。

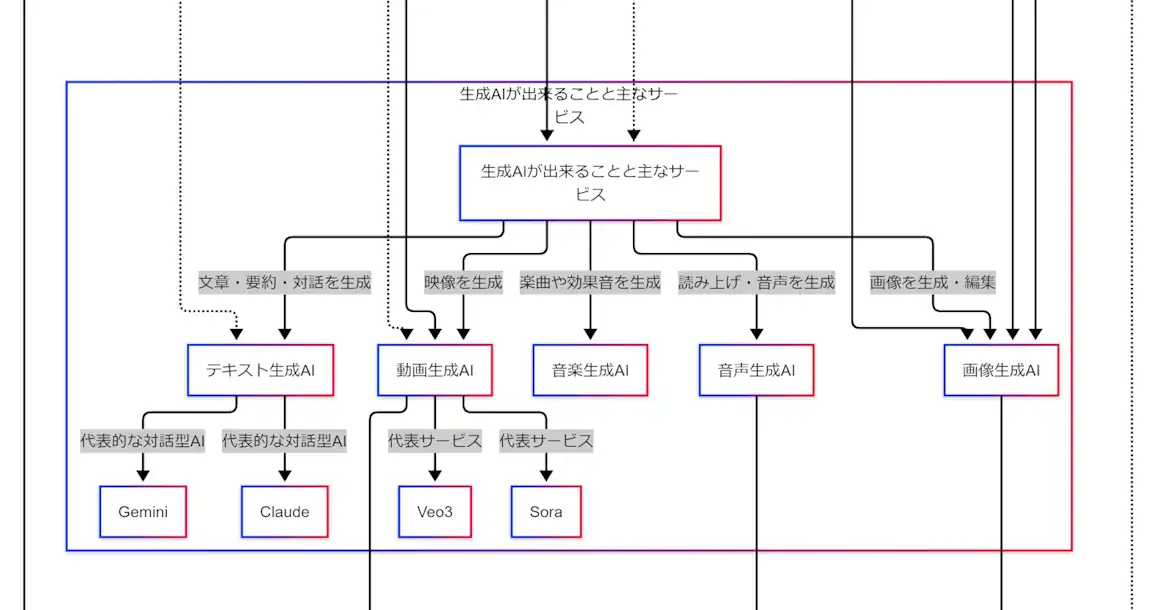

画像・動画生成AIに関連する処理

画像や動画生成AIでは、生成そのものだけでなく、データを扱いやすくする処理も重要です。

主な処理は次のとおりです。

- 画像のリサイズ

- 正規化

- データの水増し

- データ拡張技術

- リマスタリング

画像のリサイズは、大きさをそろえる処理です。正規化は、学習しやすい形に整える処理です。データの水増しやデータ拡張技術は、画像を回転させる、明るさを変える、ノイズを加えるなどして、学習データのバリエーションを増やす考え方です。

リマスタリングは、既存の映像や音源を高品質化する処理として理解できます。古い映像を見やすくしたり、音源を聞きやすくしたりする方向の技術です。

これらの処理は、画像や動画を「作る」だけでなく、「使いやすく整える」「品質を上げる」という観点でも重要です。

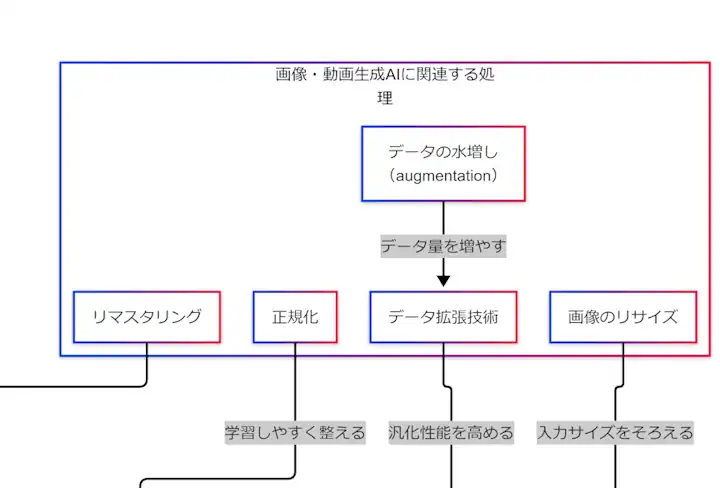

ディープフェイクの危険性

画像、動画、音声の生成技術が発展すると、本物のように見える偽のコンテンツを作りやすくなります。その代表的なリスクがディープフェイクです。

ディープフェイクは、深層学習などを使って、人物の顔、声、動きなどを本物らしく合成・加工する技術です。NISTの資料でも、合成顔や顔の変形などの技術が扱われており、合成メディアは利活用と脅威の両面から見られています。(NIST Pages)

ディープフェイクのリスクは、次のように整理できます。

- 偽情報

- なりすまし

- 詐欺

- 誤認

- 社会的混乱

特に音声や動画を使ったなりすましは、本人確認や意思決定に影響します。米国FinCENも、金融機関を狙う詐欺でディープフェイクメディアの利用が疑われる報告が増えたと注意喚起しています。(FinCEN.gov)

生成AIパスポート対策では、ディープフェイクを単なる技術名として覚えるだけでは不十分です。「本物らしく見える」「本人に見える」「本人の声に聞こえる」ことが、偽情報、なりすまし、詐欺につながる点まで押さえる必要があります。

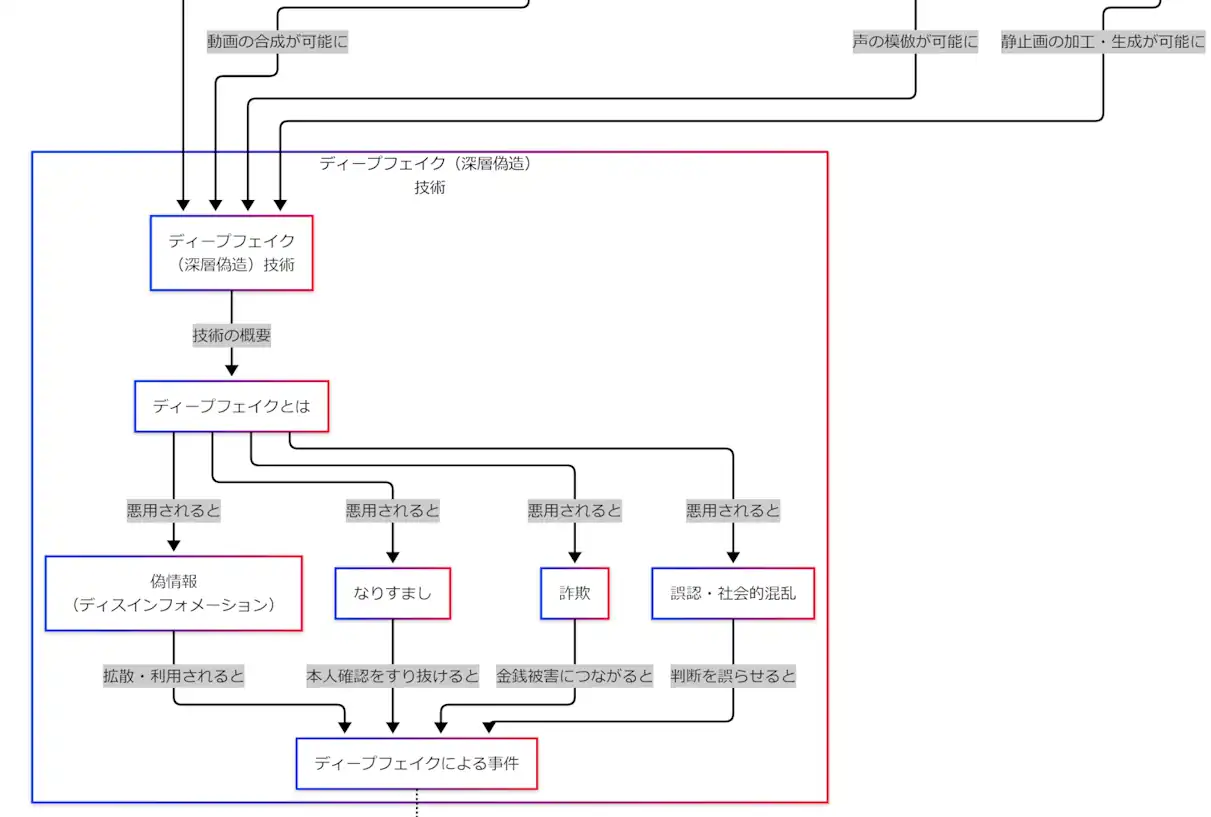

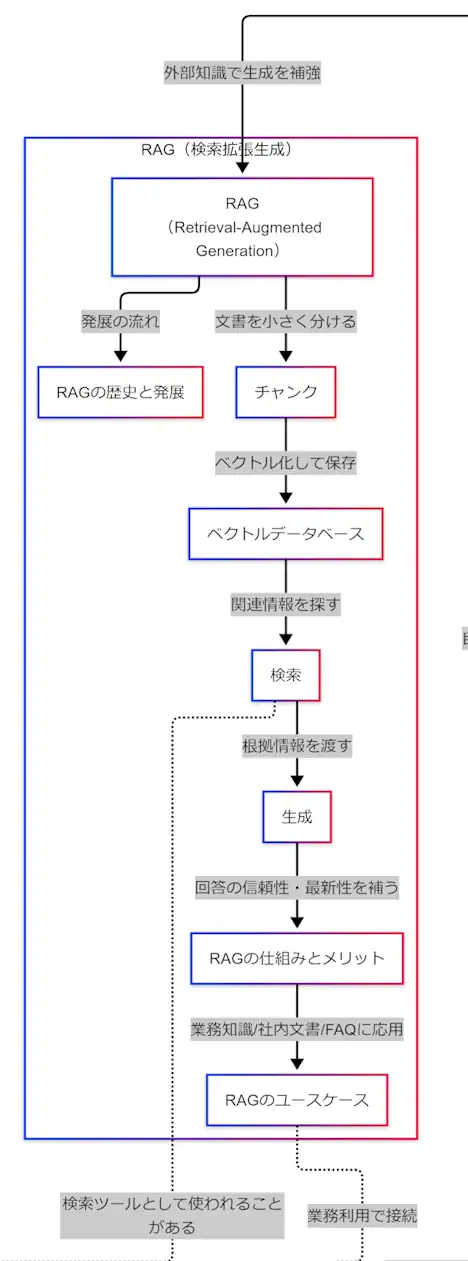

RAGとは

RAGは、Retrieval-Augmented Generationの略で、日本語では検索拡張生成と呼ばれます。

RAGは、生成AIに外部情報を参照させて回答を補強する仕組みです。モデルが内部に持つ知識だけで答えるのではなく、関連する文書を検索し、その情報をもとに回答を生成します。RAGの代表的な論文では、生成モデルに外部の非パラメトリックメモリ、つまり検索できる知識源を組み合わせる考え方が示されています。(arXiv)

RAGの基本的な流れは次のとおりです。

- 文書をチャンクに分ける

- チャンクをベクトル化する

- ベクトルデータベースに保存する

- 質問に近い情報を検索する

- 検索結果をもとに回答を生成する

チャンクとは、長い文書を扱いやすい小さなまとまりに分けたものです。社内マニュアルやFAQのような長い資料を、そのまま扱うのではなく、検索しやすい単位に分けます。

ベクトルデータベースは、意味の近さで情報を探しやすくするための保存先です。質問と意味が近いチャンクを検索し、その情報を生成AIに渡します。

RAGは、生成AIの回答に根拠や最新情報を加えたい場面で役立ちます。社内文書検索、FAQ応答、業務知識の活用などと相性がよい仕組みです。

RAGのメリットと注意点

RAGのメリットは、回答の信頼性や最新性を補いやすいことです。

通常の生成AIは、学習済みの知識や入力された文脈をもとに回答します。そのため、最新情報や社内独自の情報に弱い場合があります。RAGを使うと、外部文書を検索してから回答できるため、根拠を持たせやすくなります。

ただし、RAGも万能ではありません。検索する文書が古い場合や、関係の薄い文書を取得した場合は、回答の質も下がります。RAGでは、文書の整備、チャンク設計、検索精度、回答生成の制御が重要です。

生成AIパスポートでは、RAGを「検索してから答える仕組み」として覚えると理解しやすくなります。

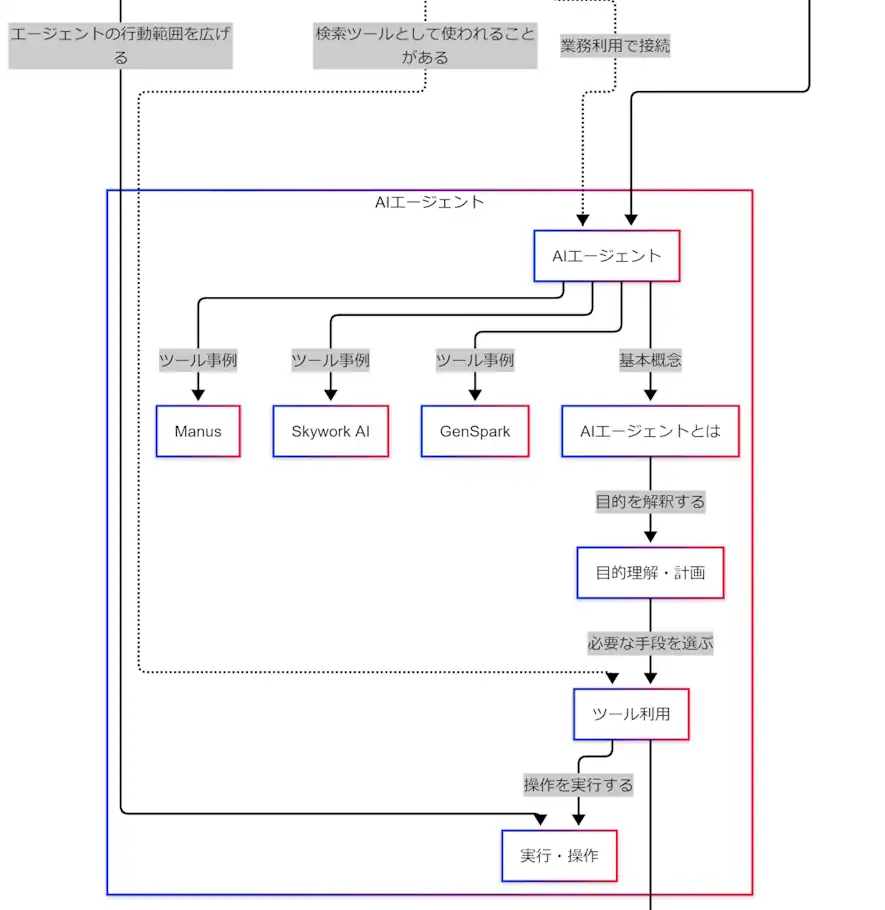

AIエージェントとは

AIエージェントは、目的を理解し、計画を立て、必要なツールを使い、タスクを進めるAIです。

通常のチャットAIが「質問に答える」ことを中心にするのに対して、AIエージェントは「目的に向かって行動する」方向に進みます。OpenAIのAgents SDKドキュメントでは、エージェントを、計画し、ツールを呼び出し、複数ステップの作業を進めるアプリケーションとして説明しています。(OpenAI Developers)

AIエージェントの基本的な流れは次のとおりです。

- 目的理解

- 計画

- ツール利用

- 実行

目的理解では、ユーザーが何をしたいのかを読み取ります。計画では、どの順番で作業するかを考えます。ツール利用では、検索、ブラウザ、ファイル操作、表計算、コード実行などを選びます。実行では、選んだツールを使ってタスクを進めます。

GenSpark、Manus、Skywork AIのようなサービスは、AIエージェント系のツール事例として整理できます。大切なのは、個別サービスの細かな機能比較ではなく、「目的理解、計画、ツール利用、実行」という流れに置いて理解することです。

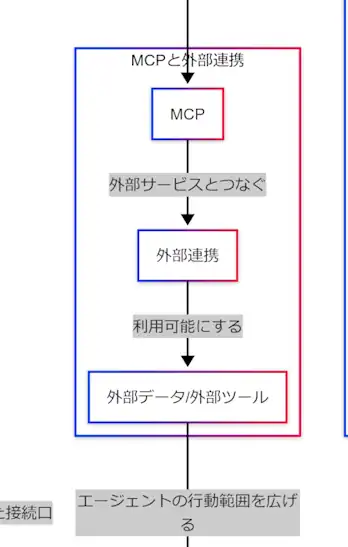

MCPとは

MCPは、Model Context Protocolの略です。AIが外部サービスや外部ツールとつながるための共通の入口として理解するとわかりやすいです。

MCPの公式ドキュメントでは、MCPはAIアプリケーションを外部システムへ接続するためのオープン標準と説明されています。外部システムには、ローカルファイル、データベース、検索エンジン、計算ツール、業務フローなどが含まれます。(Model Context Protocol)

AIエージェントが外部ツールを使うには、外部データや外部サービスにアクセスする道が必要です。MCPは、その接続を標準化する考え方として登場します。

RAG、AIエージェント、MCPは、それぞれ次のように整理できます。

- RAG:外部知識を検索して回答を補強

- AIエージェント:目的に向かってツールを使いながら作業

- MCP:AIと外部サービスをつなぐ入口

この3つを並べると、現在の生成AIが「答えるAI」から「調べて、使って、進めるAI」へ広がっていることがわかります。

生成AIパスポート対策の覚え方

現在の生成AIの動向は、用語が多く見えます。しかし、流れで押さえると整理しやすくなります。

まず、生成AIで作れるものが広がっています。テキスト、画像、音楽、音声、動画です。次に、画像・動画・音声の生成精度が上がるほど、ディープフェイクの危険性も高まります。

そのうえで、生成AIの回答に外部知識を加える仕組みとしてRAGが出てきます。さらに、AIが目的に沿って作業を進める仕組みとしてAIエージェントが登場します。そして、AIエージェントが外部サービスや外部ツールを使うための入口としてMCPを置くと、全体像がつながります。

試験対策では、次の対応関係を押さえると安定します。

- 生成AI:テキスト、画像、音楽、音声、動画を生成

- ディープフェイク:偽情報、なりすまし、詐欺、誤認、社会的混乱

- RAG:チャンク、ベクトルデータベース、検索、生成

- AIエージェント:目的理解、計画、ツール利用、実行

- MCP:外部サービス、外部データ、外部ツールとの接続

用語が増えても、この対応関係に戻れば整理できます。

FAQ

生成AIパスポートで現在の生成AIの動向はどう覚えるべきですか?

まずは、生成AIで作れるものをテキスト、画像、音楽、音声、動画に分けて整理します。そのうえで、ディープフェイク、RAG、AIエージェント、MCPへ流れを作ると覚えやすくなります。

ディープフェイクはなぜ危険ですか?

本物の人物の顔や声のように見えるコンテンツを作れるためです。偽情報、なりすまし、詐欺、誤認、社会的混乱につながる可能性があります。

RAGとは何ですか?

RAGは検索拡張生成のことです。外部文書を検索し、その情報をもとに生成AIが回答を作る仕組みです。社内文書検索、FAQ応答、業務知識の活用などに使われます。

RAGで重要な用語は何ですか?

チャンク、ベクトルデータベース、検索、生成が重要です。文書をチャンクに分け、ベクトルデータベースに保存し、関連情報を検索してから回答を生成します。

AIエージェントとは何ですか?

AIエージェントは、目的を理解し、計画を立て、必要なツールを使い、タスクを進めるAIです。単に回答するだけでなく、作業を進める方向のAIとして理解できます。

MCPとは何ですか?

MCPは、AIが外部サービスや外部ツールとつながるための共通の入口です。AIエージェントが外部データやツールを使う場面で重要になります。

まとめ

現在の生成AIは、テキスト、画像、音楽、音声、動画まで生成対象を広げています。便利さが増す一方で、ディープフェイクのようなリスクも重要になっています。

RAGは、外部知識を検索して回答を補強する仕組みです。チャンク、ベクトルデータベース、検索、生成の流れで押さえると理解しやすくなります。

AIエージェントは、目的理解、計画、ツール利用、実行の流れでタスクを進めるAIです。MCPは、そのAIエージェントが外部サービスや外部ツールとつながるための入口として整理できます。

- 生成AIは、テキストから動画まで生成対象が拡大

- ディープフェイク、RAG、AIエージェント、MCPは流れで理解

- 試験対策では、単語よりも関係性と順番を重視

参考文献

OpenAI Help Center「Sora」

https://help.openai.com/en/collections/11106745-sora

Google DeepMind「Veo」

https://deepmind.google/models/veo/

Anthropic「Claude」

https://claude.com/?__locale=ja-JP

Google「Gemini」

https://gemini.google.com/?hl=ja

Patrick Lewis et al.「Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks」

https://arxiv.org/abs/2005.11401

NIST「Synthetics and DeepFakes」

https://pages.nist.gov/ifpc/2022/presentations/17_NIST_IFPC_Synthetics_and_DeepFakes.pdf

FinCEN「FinCEN Alert on Deepfake Media and Fraud Schemes」

https://www.fincen.gov/sites/default/files/shared/FinCEN-Alert-DeepFakes-Alert508FINAL.pdf

OpenAI Developers「Agents SDK」

https://developers.openai.com/api/docs/guides/agents

Model Context Protocol Documentation「What is the Model Context Protocol?」

https://modelcontextprotocol.io/docs/getting-started/intro

書籍

生成AIパスポート対策

- 公式テキスト第4版対応版 生成AIパスポート テキスト&問題集

- 生成AIパスポートの試験対策向け

- シラバスに沿って、生成AIの基礎、リスク、RAG、AIエージェントなどを整理

- まず試験範囲を押さえたい人向け

生成AI・AI技術の基礎

- あたらしい人工知能技術の教科書 第2版

- AI全体の基礎を学びたい人向け

- 機械学習、深層学習、強化学習などを幅広く整理

- 生成AIの前提知識を固める一冊

- 深層学習 改訂第2版

- 深層学習を理論寄りに理解したい人向け

- ニューラルネットワーク、Transformer、生成モデルなどの理解に役立つ内容

- 生成AIの仕組みを深く追いたい人向け

- ゼロから作るDeep Learning 生成モデル編

- 画像生成AIや生成モデルを実装しながら理解したい人向け

- VAE、GAN、拡散モデルなどを手を動かして学習

- 画像生成AIの裏側を知りたい人におすすめ

LLM・RAG・AIエージェント

- 大規模言語モデル入門

- LLMの基礎を学びたい人向け

- Transformer、事前学習、ファインチューニング、文書検索などを整理

- RAGを理解する前段階として相性が良い一冊

- LangChainとLangGraphによるRAG・AIエージェント[実践]入門

- RAGやAIエージェントを実装したい人向け

- LangChain、LangGraph、OpenAI APIを使った実践寄りの内容

- 記事内のRAG、AIエージェントの章を深掘りする本として最適

- AWSではじめる生成AI

- 生成AIを業務利用やクラウド活用につなげたい人向け

- 基盤モデル、プロンプト、RAG、デプロイなどを実務目線で整理

- 社内文書検索や業務ナレッジ活用を考える人向け

ディープフェイク・偽情報・メディアリテラシー

- フェイクニュース 新しい戦略的戦争兵器

- 偽情報や情報操作の社会的影響を知りたい人向け

- ディープフェイクによる混乱や世論操作を理解する補助になる一冊

- 生成AIのリスク面を学びたい人向け

- メディアリテラシー 吟味思考を育む

- 情報を見極める力を身につけたい人向け

- ニュース、SNS、画像、動画などの情報判断を学ぶ内容

- ディープフェイク時代の基礎力づくりに有用

生成AIの法律・著作権・リスク

- 生成AIの法律実務

- 生成AIを業務利用する人向け

- 著作権、契約、個人情報、責任問題などを実務目線で整理

- 企業で生成AIを使う前に確認したい一冊

- 生成AIと著作権の論点

- 生成AIと著作権を重点的に学びたい人向け

- 学習データ、生成物、権利侵害、RAG利用などの論点整理に有用

- 生成AIパスポートのリスク理解を深める本として相性良好

コメント